El ingeniero eléctrico jefe de Google Glass ficha por Oculus

16 MAY 2014 14:48

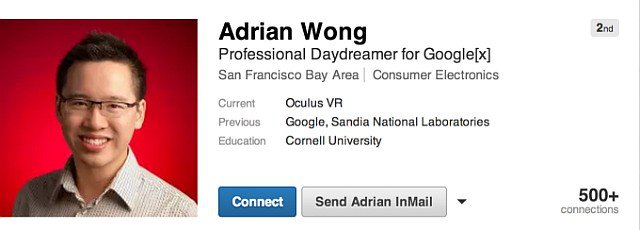

Va a llegar un momento en el que las nuevas incorporaciones a Oculus van a dejar de ser noticia, porque llevamos una detrás de otra. Hoy es el turno nada menos que Adrian Wong, ingeniero técnico jefe de Google Glass, que ha decidido cambiar de aires y fichar por la compañía de Palmer Luckey. El 2 de mayo dejó una nota de despedida a sus seguidores en Google y ahora sabemos su destino.

Techcrunch es quien ha publicado la noticia, afirmando que aunque todavía aparece como empleado de Google en su red social, Google+, en Facebook ya aparece su nueva ubicación.

El perfil de Linkedln lo define como el ex-director de ingeniería de los sistemas, cámara y RF de la versión comercial de Google Glass, y como ingeniero de hardware senior de la Explorer edition, donde se encargó de la creación de prototipos, el diseño del subsistema de pantalla y el PCB HDI. Seguro que su experiencia en el diseño de Google Glass va a ser más que bienvenida en Oculus VR.

rafa

#52 19 MAY 2014 14:06

Son cifras para hypearse y mucho! Con el eye tracking está mas que justificada una inversión importante en la pantalla , ya no debe haber miedo a tener un panel a 2, 4 u 8k o lo que sea.

Un cálculos sobre que resolución final tendría que renderizar el ordenador (suponiendo que la resolución de los pixeles que el usuario no va a mirar directamente se reduzca 4 veces)

Monitor Fovrender Carga Carga total

1080p 5% 54p (1026p / 4) + 54p = 310p

1080p 25% 270p (810 / 4) + 270p = 472p

1900p 5% 95p (1805 / 4) + 95p = 546p

1900p 25% 475p (1425 / 4) + 475p = 831p

4000p 5% 200p (3800 / 4) + 200p = 1150p

4000p 25% 1000p (3000 / 4) + 1000 = 1750p

Osea, un monitor de 7000 x 4000p haría trabajar al ordenador a 1150p o 1750p

Pelacanyes

Visores

#53 19 MAY 2014 15:28

De mi escepticismo inicial, me estan subiendo las esperanzas con este tema, he estado pensado en ello y cada vez creo que es más factible. No entiendo nada de óptica pero me he dado cuenta de que cuando el ojo se mueve de un punto a otro punto tarda x tiempo en enfocar aunque nosotros no seamos conscientes, hay un retraso entre que el ojo se mueve, enfoca y finalmente el cerebro interpreta la imagen. El software cómodamente le daria tiempo (si no estoy muy equivocado) a renderizar con la suficiente rapidez para no percatarnos del "foveated rendering". Ahí es donde yo veo esperanzas en que esta tecnologia sea una revolución en el rendimiento!

Morpheox

#54 19 MAY 2014 19:27

Lo sera sin ninguna duda, aqui la discusion es cuando lo hará, y en mi opinión no sera para el CV1, es una caracteristica demasiado importante como para añadirla a la ligera, necesita mucho refinamiento y desarollo, no es algo que puedas añadir por que si.

Pero en cuanto que en el futuro sera añadido en un hmd, estoy casi seguro de que asi sera.