MidJourney y las IAs que interpretan nuestros sueños

6 JUN 2022 15:00

El diseñador Javier de Prado se sienta con una IA y juntos definen una realidad diferente.

Lenguajes y metalenguajes

Decía Lovecraft que hay quienes se han atrevido a asomarse al otro lado del velo [...] y aquellos que entraren no podrán volver jamás, porque en los espacios infinitos que transcienden nuestro mundo existen formas tenebrosas que atrapan y envuelven [...] más allá de todos los mundos, hasta el Abismo de los devoradores innominados.

Hace mucho tiempo que Javier de Prado (@navalguijo), metaversólogo de profesión, cruzó el velo para explorar lo más profundo del interface hombre-máquina. Tras uno de estos viajes, Real o Virtual ha tenido la suerte de compartir con él eso que el abismo le devuelve cuando Javier de Prado -apostado sobre el filo de la cordura- le grita a los dioses del infra-ciber-mundo.

Aunque las IA que convierten texto a imagen llevan unos años funcionando en las sombras, de un tiempo a esta parte (más las últimas semanas) se han vuelto virales gracias a dos iniciativas: Dall-E y MidJourney.

Otro día entraremos a explicar cuáles son los entresijos algorítmicos y matriciales por los cuales una máquina es capaz de dibujar contextos y formas a partir de nombres y adjetivos. Eso se sitúa en la técnica. Hoy, en este artículo, nos quedaremos con el alma de aquello que alguna vez podría llegar a dibujar los mundos procedurales del metaverso que seguro que caminaremos con nuestros visores.

En la confección de este grimorio que sugiere venir de lugares muy lejanos, extraños e inquietantes, Javier de Prado ha experimentado con el lenguaje de una manera que redefine los límites del arte. Porque hasta ahora, el humano necesitaba recoger una pluma y afrontar un lienzo donde pintar -o traducir- en él su imaginación. Podría también dictarlo a distancia y dejar que ese otro transformara la realidad interior de quien lo hablaba. Sea como fuera, durante siglos al menos el pincel ha sido el agente de todo el proceso.

Hasta hoy.

La inteligencia artificial, apoyándose en miles de imágenes reales, está aprendiendo a conceptualizar lo que las palabras traducen. Un viaje de ida y vuelta que comienza con Quine y su conductismo del lenguaje (su comportamiento, de dónde viene, cómo se genera en nuestro cerebro y se desarrolla después) y termina con una IA creando con ese lenguaje una imagen cargada con los sesgos de su database (las imágenes con las que la IA ha aprendido). Ese camino transita por un universo extraño cuyos resultados, a menudo, no producen la empatía acostumbrada. Somos espectadores de una nueva concepción de arte que parece abrazar el manierismo más radical. Al carecer de humanidad, se acaba la tendencia a la repetición sesgada y desaparecen las referencias propias asociadas a experiencias reales, gestos aprendidos, estímulos privados, cualquier detalle propio del artista que haya llevado a definir su personalidad... la IA es máquina, repulsiva a veces y sobrecogedora otras tantas. Desconcertante cuando le buscamos el parecido con el arte humano.

GALERÍA

Empezamos el viaje de Javier de Prado con una IA llamada The Big Sleep, basada en las redes neuronales CLIP (Contrastive Language-Image Pre-Training) y GAN (Redes Generativas Antagónicas). El prompt (sugerencia) será la frase con la que Javier de Prado alimente todos los sistemas que veremos a continuación.

Prompt: "An artificial inteligence that translates text into images"

(Una inteligencia artificial que traduce texto en imágenes)

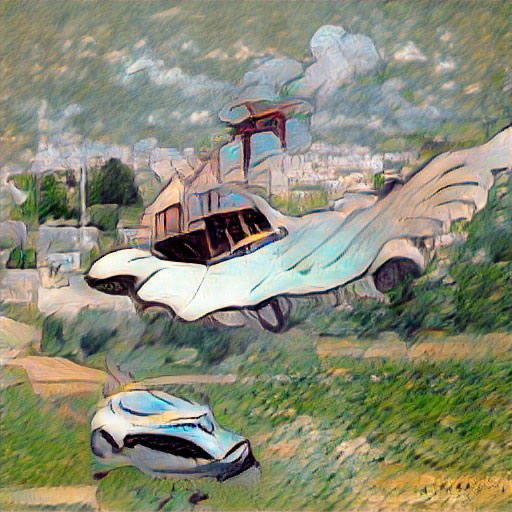

Lo más curioso de estos sistemas llega cuando le pides mezclar estilos y autores. Cuanto más alejado, mejor.

Prompt: "A flying car from the future, in Touluse-Lautrec style"

(Un coche volador del futuro en un estilo Toulose-Lautrec)

El trabajo de Javier de Prado con la imagen generada le lleva desde The Big Sleep a Aleph2image, otra IA basada en CLIP pero añadiendo OpenAI DALL-E.

"The blueprint of an alien spaceship that can travel through time"

(El blueprint de una nave espacial alien que puede viajar a través del tiempo)

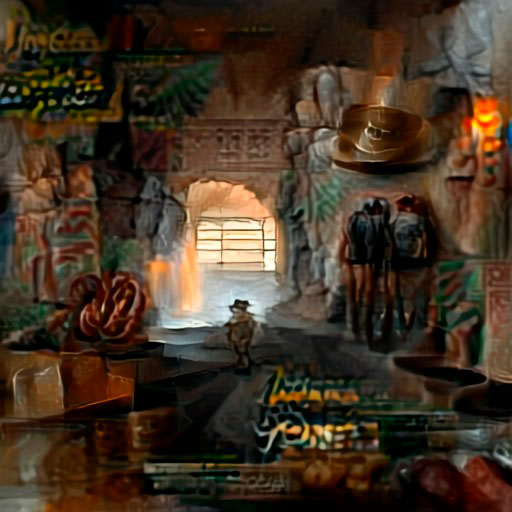

"a screenshot of Indiana Jones point and click adventure"

"a screenshot of Indiana Jones point and click adventure"

(Una captura de la aventura gráfica Indiana Jones de point & click)

Probando otro tipo de IA, Javier se acerca a Gaugan, una IA de Nvidia que interpreta dibujos y crea después fotografías basadas en ellas. Sin embargo, una parte del código también permitía Text2Image.

"New York City"

Otra IA muy conocida en la traducción de palabras a imagen es Pixray. Esta red basada en Perception Engines, GAN y PLAT (plan out or make a map of) permite hacer pruebas públicas con una cola de espera que varía entre los diez minutos y media hora de espera para la generación de imágenes.

"Teide Exploding"

"Teide Exploding"

Basado también GAN, tenemos WOMBO, famosa también por sus videos virales que animan una foto y el sujeto parece cantar y bailar al ritmo de la canción.

"Brain cake"

"Brain cake"

"Batman in Goya style"

Y así llegamos a MidJourney , la IA que compite con Dall-E y con "imagen" de Google. Millones de fotografías detrás del algoritmo y toda la potencia de sus servidores para generar imágenes desde texto en solo unos segundos.

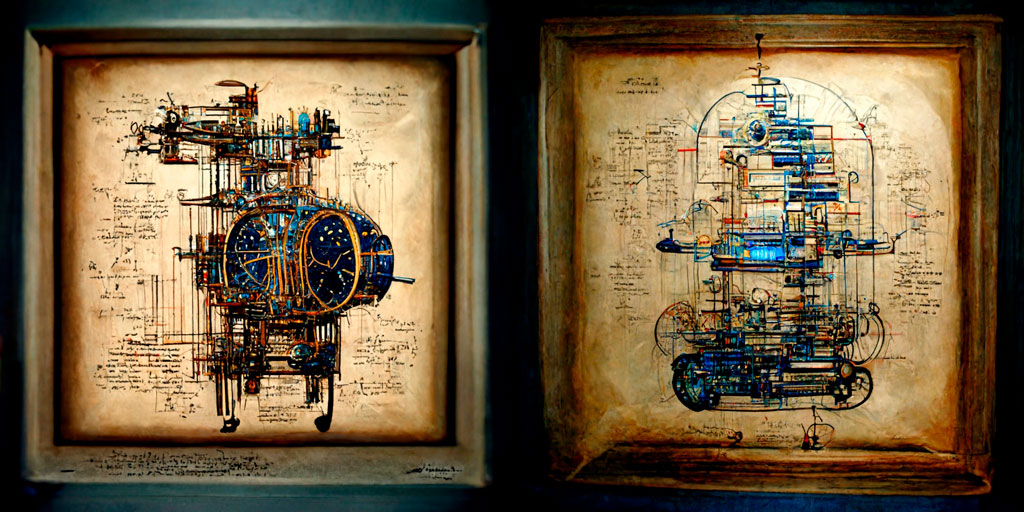

Díptico "Blueprint of a Time Machine"

(Blueprint de una máquina del tiempo)

Por la propia naturaleza onírica de MidJourney, los mejores resultados provienen de todo aquello que haga referencia a sueños, sensaciones y mente.

"Midjourney's deepest dream"

"Midjourney's deepest dream"

(El sueño más profundo de MidJourney)

"A concept art of a cloud city festival at dawn"

(Arte conceptual del festival en una ciudad de nubes al atardecer)

En el ejemplo siguiente, el prompt sitúa el punto de vista en la rueda del coche. La IA es capaz de imaginar cómo se refleja la acción en su cromado del tapacubos y generar un POV (izq. de la imagen) de lo que ocurre en la derecha.

También ocurre en la segunda, donde la IA crea aberraciones y espejos para simular la petición de Javier de mostrar una imagen desde dentro del acuario.

"Car chase, shot from the wheel"

(Persecución de coches, desde el punto de vista de la rueda)

"Inside a fish tank"

(Dentro de un acuario)

Sin lugar a dudas, es en el retrato donde la IA de MidJourney saca lo mejor del algoritmo de aprendizaje -y si no le da por distorsionar los gestos y la geometría de la cara-, los resultados llevan un nivel de detalle asombroso, tanto en gestos como en la iluminación del rostro:

1 "portrait of Guybrush Threepwood from Monkey Island videogame"

(Retrato de Guybrush Threepwood del videojuego Monkey Island)

2 "Chip and Dale's Sonic"

3 "female teacher trapped inside a sandglass"

(Profesora femenina atrapada dentro de un reloj de arena)

4 "a dark bearded god cyber human beautiful face dressed in a broken white dirty robe"

(Un cyber dios de barba con cara bonita vestido en una túnica rota, sucia y blanca)

Izq. "illustration of the layers in Dante's inferno in Mucha style"

(Ilustración de las capas en el Infierno de Dante al estilo Mucha)

Drcha. "paradisiacal hell"

Los sesgos de la IA se reproducen igual que en la mayoría de nosotros: el infierno se asocia con el color rojo sin necesidad de especificarlo.

3 variaciones sobre "A realistic depiction of a space battle with multiple spaceships of different sizes"

(Una descripción realista de una batalla espacial con múltiples naves espaciales de tamaños diferentes)

El uso de una IA para trabajar la fase de prototipado se antoja inmejorable: disponer en escasos segundos de todo un conjunto de propuestas diferente en estilos distintos aceleraría la toma de decisiones antes de que el artista realizara el trabajo final con la customización necesaria para el cliente. Aspecto este último donde la IA -aún- parece no poder competir.

El surrealismo, las mezclas imposibles, ideas difíciles de conceptualizar si un humano tuviera que plasmar en papel florecen en la IA de manera fácil. Sin sesgos o límites de imaginación, el resultado es casi literal.

izq: "Extasis sweet bubble" (Burbuja dulce de éxtasis) Centro: "We all live in a yellow submarine" (todos vivimos en un submarino amarillo) Dcha: "A happy lettuce" (Una lechuga feliz)

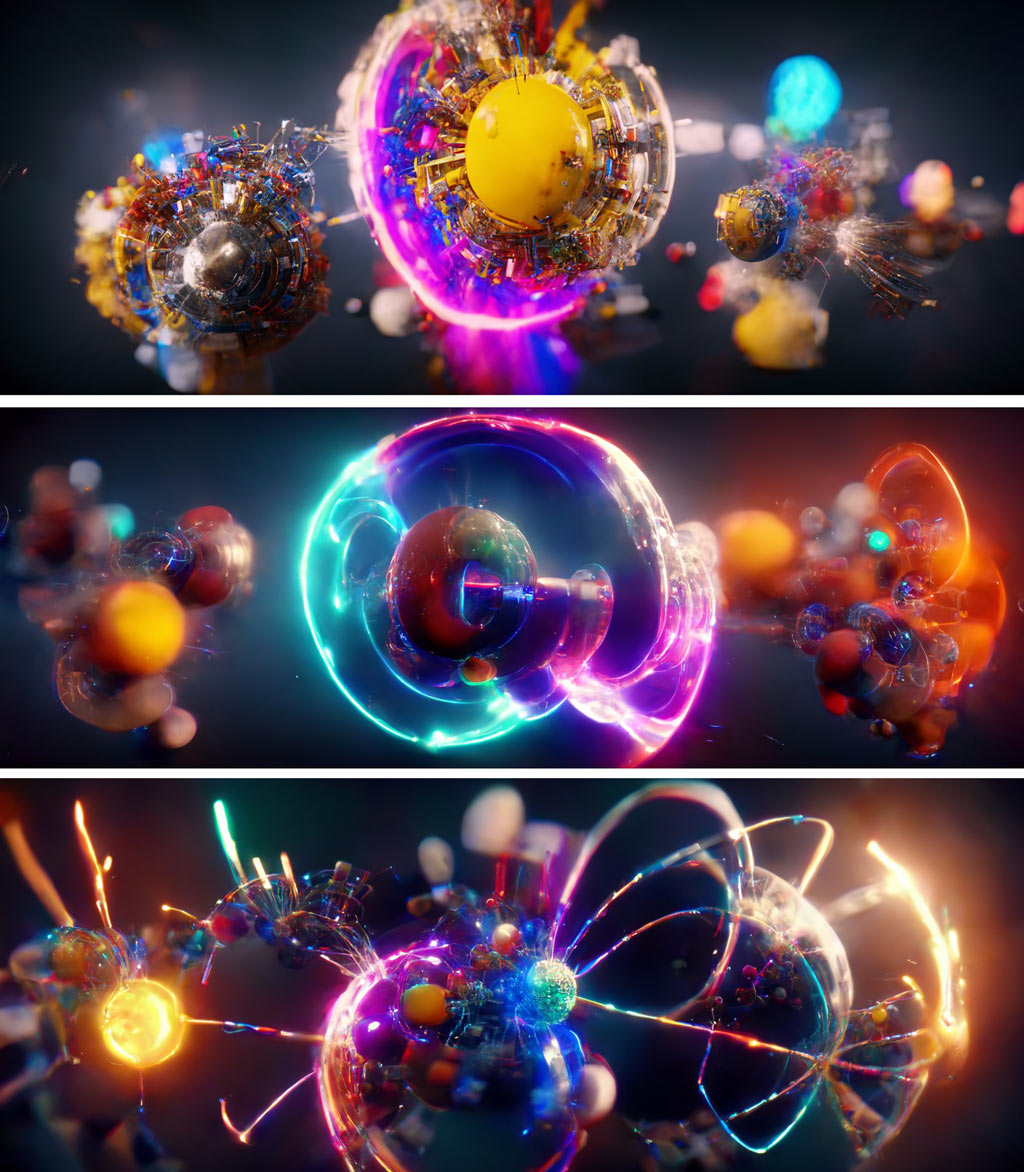

Variaciones sobre "Quark-Gluon Plasma"

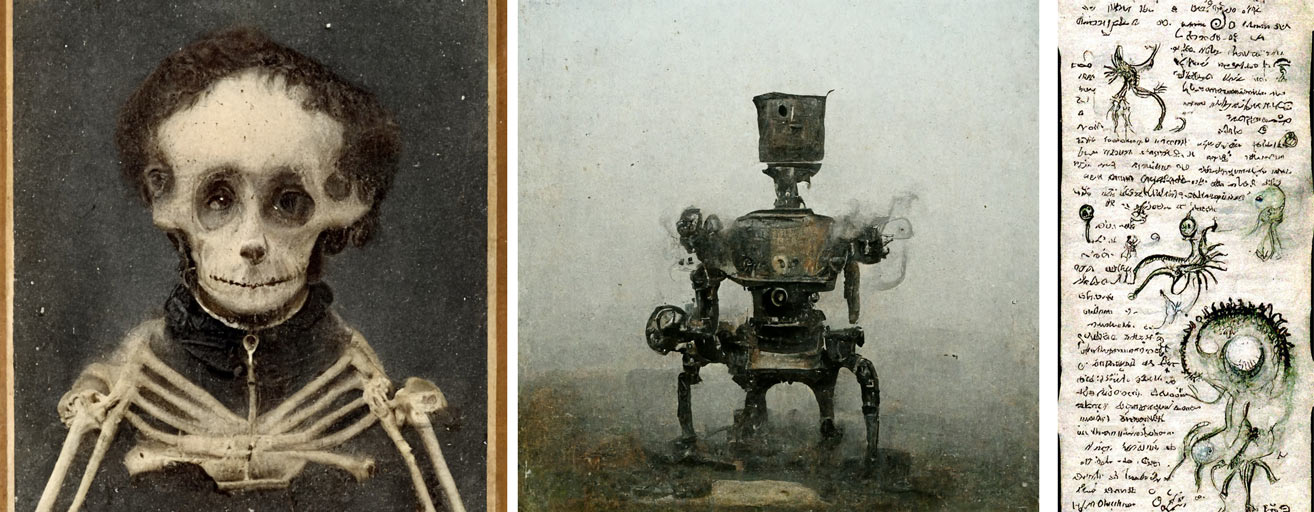

Izq: "A funny daguerrotype of a skeleton. From 1839" (Un daguerotipo divertido de un esqueleto) Centro: "daguerrotype of a robot. 1839." (Daguerotipo de un robot. 1839) Drcha: "a voynich manuscript page with an illustration of an alien form" (Página de un manuscrito Voynich con una ilustración de una forma alienígena)

Variaciones sobre "Tenerife's carnival with Orange Calima" (Carnaval de Tenerife con calima anaranjada"

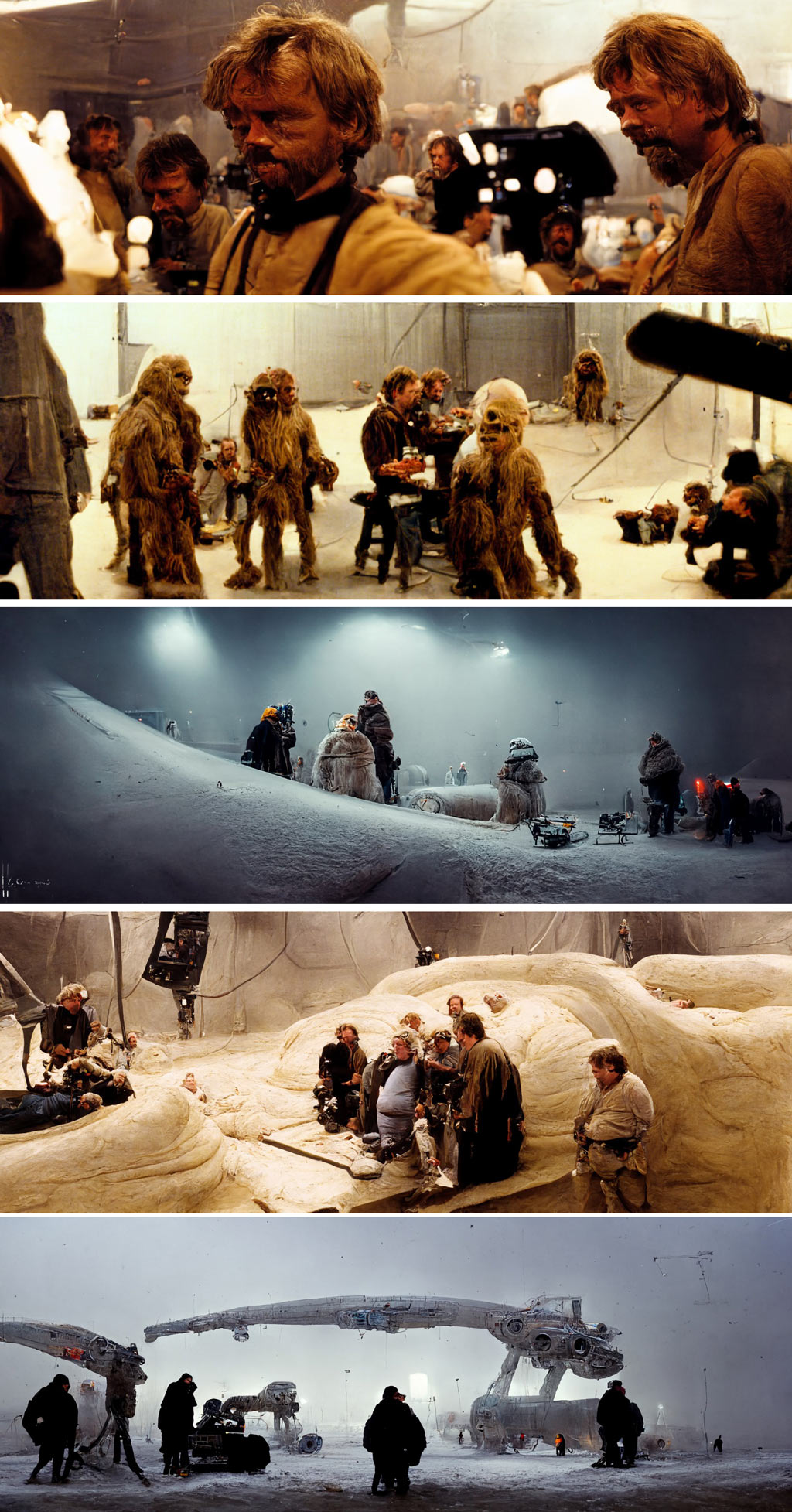

Para ilustrar hasta dónde puede llegar la IA generando imágenes de eventos conocidos, Javier de Prado le pidió a MidJouney recrear el making of de algunas películas (Star Wars más abajo). Recordad que estas imágenes muestran una realidad que nunca existió de verdad.

Por último, Javier de Prado nos propone un paseo por diversos prompts relacionados con la realidad virtual, visores y usuarios desde un puñado de estilos diferentes:

Desde Real o Virtual queremos agradecer a Javier de Prado la colaboración compartiendo sus prompts y resultados con toda la comunidad virtual de ROV.

Angel_

Visores

#21 8 JUN 2022 22:25

sigo...XD

Entendiendo como humano minimo un ser consciente (no hace falta que sea humano) deberia ser capaz de reconocerse como un ente unico, disponer de capacidad de aprendizaje , imaginacion para desarrollar herramientas y arte, y lenguaje para transmitir su cultura.

Biologicamente seguiremos siendo humanos (h. sapiens) mientras seamos capaces de reproducirnos entre nosotros.Los implantes ciberneticos no hacen que dejemos de pertenecer a nuestra especie, las modificaciones geneticas si podrian hacerlo.

Los valores morales de cada sociedad son los que han forjado su cultura y no tenemos derecho a decir cuales son los mejores...o eso diria mi hermana la doctora en antropologia social, yo creo que y una mierda Una cultura como la occidental basada en el respeto mutuo y la libertad individual crea sociedades mas felices y prosperas y es por tanto superior.

Una cultura como la occidental basada en el respeto mutuo y la libertad individual crea sociedades mas felices y prosperas y es por tanto superior.

No veo porque una herramienta nos limita, Shakespeare y Hitler fueron escritores pero uno uso la pluma para dejarnos obras universales donde conocernos a nosotros mismos y el otro una justificacion para el genocidio.

Un robot no usaria la VR igual que nosotros, si das la suficiente libertad para actuar en el multiverso cada cultura, incluso cada persona dentro de la suya actuaria de manera diferente.

Si no has leido "El corazon de las tinieblas" habras visto "Apocalipsis Now" la historia de un hombre que aislado en el salvajismo sin ninguna autoridad moral que lo censure se abandona a sus peores instintos.Podria experimentase si en el metaverso no hubiera limites ni censura, hasta donde seriamos capaces de llegar en un mundo donde nuestros actos no tienen consecuencias?

El tema de la IA en autos es interesante, un reto moral pero en la practica si fueras tu a pagar ese coche acaso no pedirias que su prioridad fuera protegerte a ti y a tu familia por encima de todo?