Nreal Light: ANÁLISIS

17 SEP 2021 13:00

Desafiando los límites de la realidad.

De Ballenas aumentadas y lentes polarizadas

Somos forasteros en esta realidad. Al menos, forasteros en lo que Philip K. Dick llamó: "eso que sigue ahí cuando dejas de creer en ello". Para modificar la realidad que nos rodea, para aumentarla, para llevarnos sensorialmente a lugares alternativos, el ser humano solo ha tenido en sus orígenes dos posibilidades: la droga alucinógena o el sueño profundo. Por desgracia, ninguno de los dos métodos -por muy reales que nos puedan parecer- ni generan mundos persistentes ni permiten realidades colectivas. Son experiencias personales, espurias, sin control y tan frugales como dure la química que las produzca.

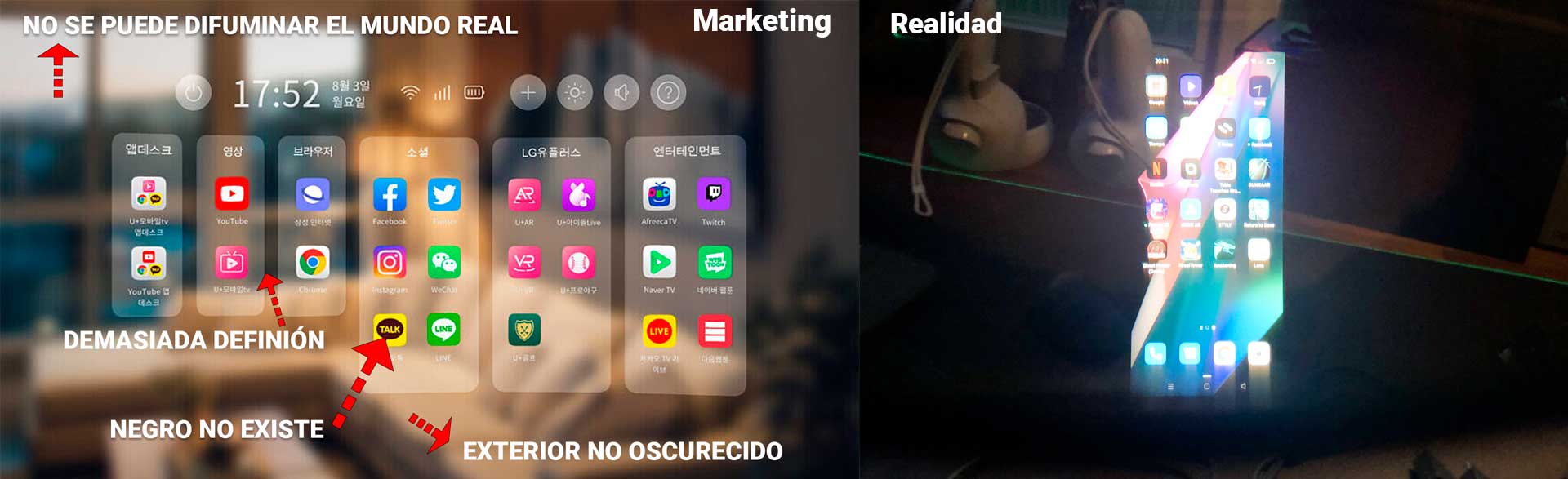

Aumentar la realidad, asistirla en detalles, mejorarla, transformarla a necesidad o mejor aún, reemplazarla por completo y mantenerla ahí, latente, disponible a solo un click, es la razón por la que todos nosotros llevamos años paseando por estas páginas de Real o Virtual y vestimos visores durante más horas de las que a nuestras familias les gustaría. Vivimos en el deseo de que la evolución técnica nos de -en algún momento- todo eso que nos prometen la campañas de marketing sobre-adulteradas que muchas veces rozan el fraude más pueril.

REALIDAD ASISTIDA

Con Facebook y Apple a punto de abrir las esclusas del metaverso y millones de usuarios dispuestos a ahogar sus ahorros en la inundación aumentada, todo apunta a que, efectivamente, el momento del cambio tecnológico -del teléfono a las gafas- se encuentra más cerca que nunca pese a todos los inmensos problemas ópticos que arrastrarán. Esta incapacidad técnica, unido al marketing más virulento con expectativas alocadas fuera de cualquier ética, puede hacer, igual que ya nos ocurrió con lo virtual, que los deseos no cumplidos vuelvan a enviar a la realidad aumentada a la casilla de salida. Por eso es tan importante no dejarse llevar y esa es la razón por la que desde Real o Virtual llevamos años aterrizando los conceptos y leyes que limitarán la calidad visual de un visor aumentado. No nos confundamos, igual que está ocurriendo en la Realidad Virtual, el viaje aumentado va a ser alucinante, solo vamos a necesitar algo más de tiempo para poder llegar a destino.

PROBLEMAS DE LA CIENCIA AUMENTADA ACTUAL. ETENDUE Y LUMINANCIA

Nreal Light, modelo pre-consumo de la compañía china que nació en 2017, propone en todos sus carteles de publicidad y videos de YouTube lo mismo que el resto de visores aumentados de esta generación: domesticar lo imposible. La Realidad Aumentada, aquella que deja ver el exterior real mezclándolo con lo virtual a través de un cristal translúcido, se enfrenta a problemas técnicos de tal magnitud (no violar la segunda ley de la termodinámica, por ejemplo) que aún está por descubrir un sistema capaz de darles respuesta a nivel global. Controlar la luz para que pase a través de una óptica nos ha llevado siglos. Controlar lo que le ocurre a esa luz una vez lo haya atravesado nos puede llevar, por desgracia, otros tantos.

A día de hoy, cualquier lector asiduo a Real o Virtual sabrá -aunque sea de oídas- que ni las lentes ni los proyectores hacen milagros. La Ley del Etendue y la ley de la luminancia son dos animales salvajes que cada semestre se llevan por delante cientos de proyectos de estudiantes de óptica.

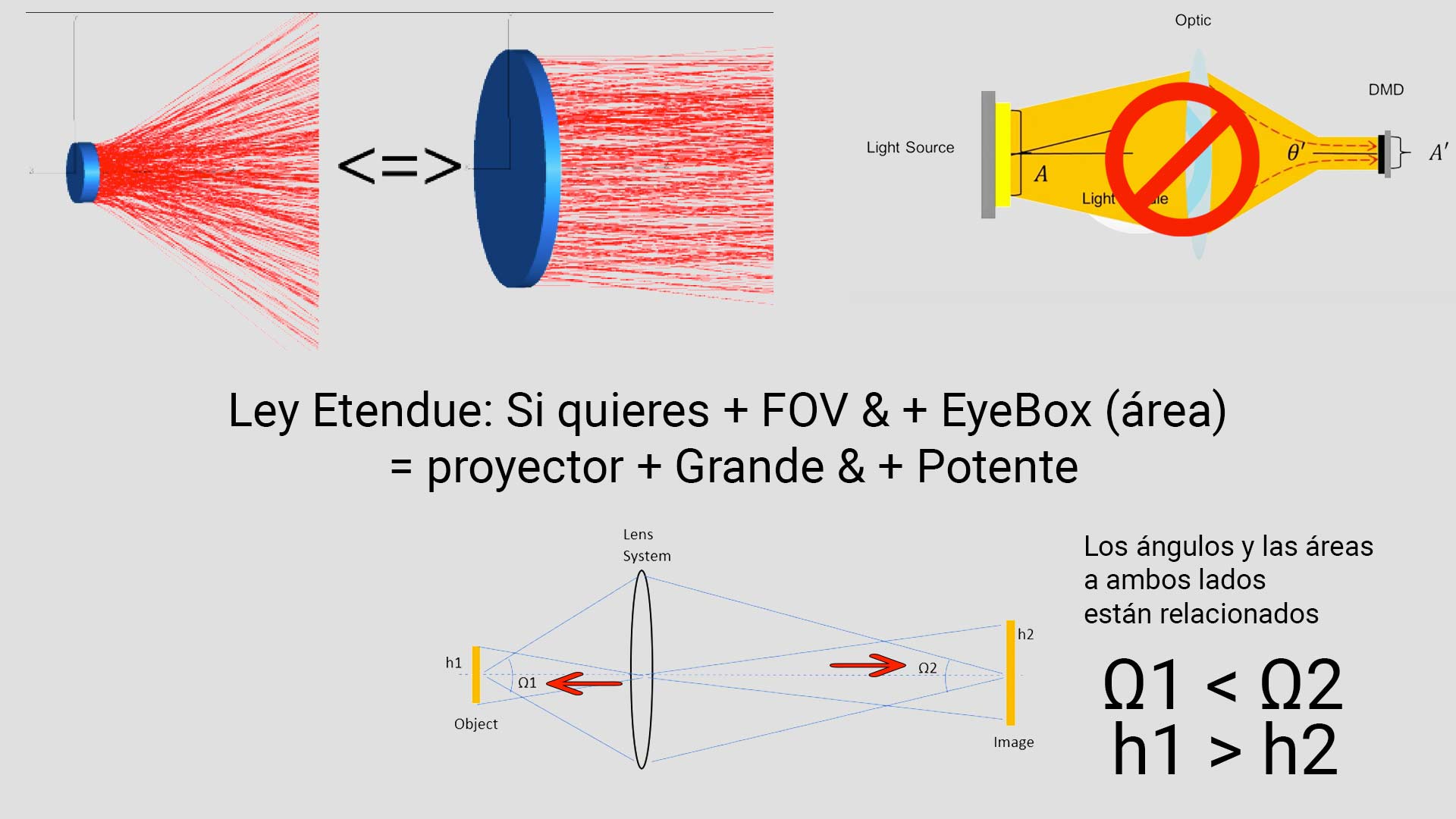

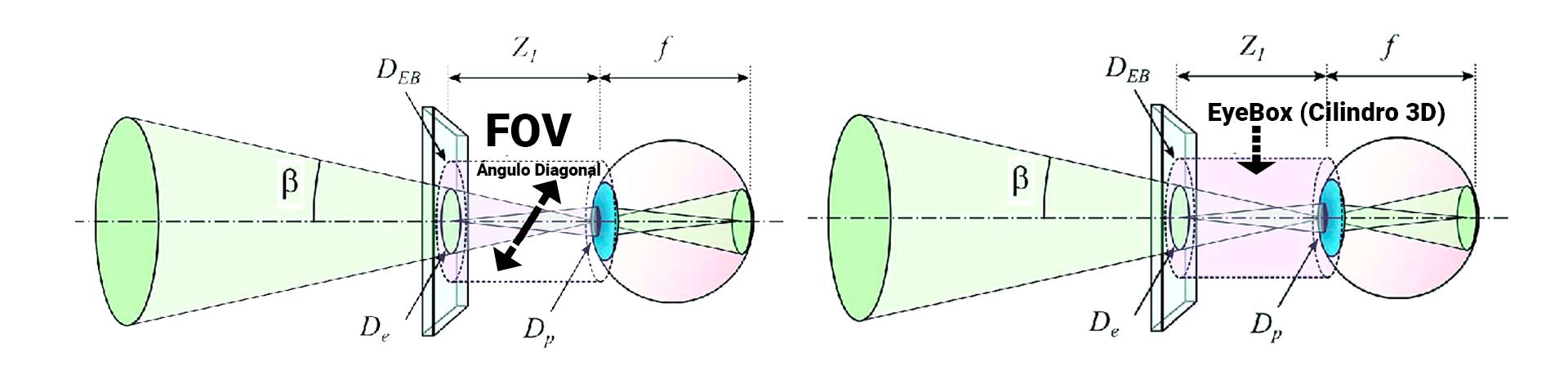

Simplificando, Etendue viene a decir que el diámetro de un haz de luz multiplicado por su ángulo, tiene que ser constante a lo largo del sistema óptico. ¿Qué límites o reglas implica esta ley para nuestros deseos aumentados? Si hablamos de gafas AR, Etendue obliga a que el tamaño del proyector multiplicado por el valor de la apertura resultante del conjunto de lentes, deberá ser siempre igual al tamaño del EyeBox resultante (el espacio tridimensional desde donde podemos ver la imagen Aumentada) multiplicado por el seno del Campo de Visión (FOV o la cantidad de imagen que podremos ver a través de la lente).

Esta relación tan difícil y poco intuitiva de entender, es la causa principal de que nuestras gafas AR no puedan hacerse más pequeñas a la vez que queremos una imagen resultante enorme. Cada vez que tocamos un tamaño o metemos una lente de más para modificar la luz, el valor de Etendue siempre aumentará y con él, también la dificultad de meter todo el sistema en unas gafas del tamaño que vemos en las películas de superhéroes.

Para que os hagáis una idea: si pudiésemos violar la Ley de Etendue, habríamos solucionado el problema de la entropía del universo (ordenar el caos sin emplear energía) y habríamos creado una máquina de movimiento perpetuo. En resumen: a día de hoy, si queremos grandes resultados, el diseño de las gafas tendrá que ser igual de grande. Y nadie, salvo Hololens o North Star, parece estar dispuesto a ello.

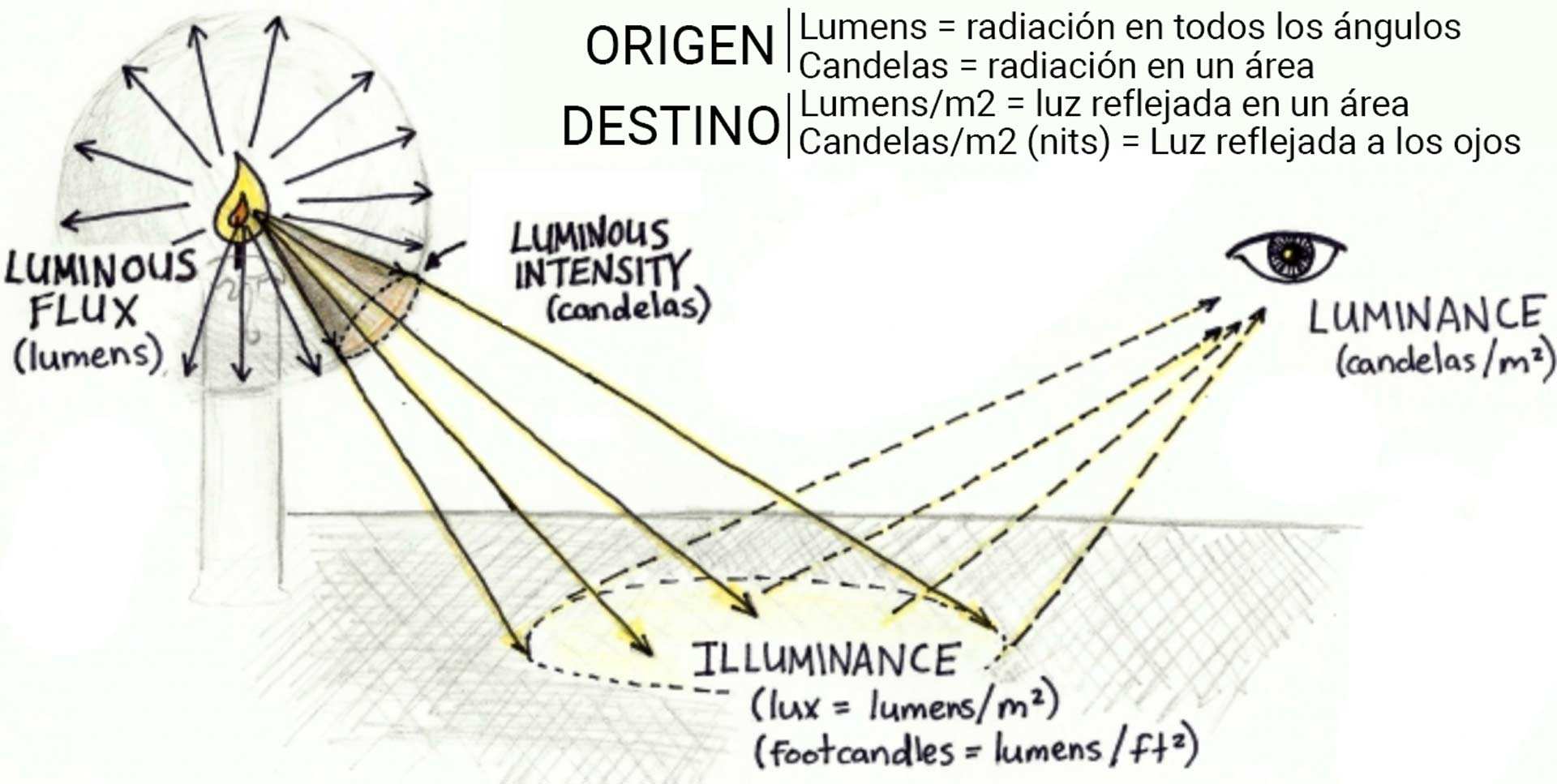

El segundo problema insalvable al que se enfrenta la AR actual es la Ley de la Luminancia (o iluminancia): ningún sistema óptico podrá aumentar la luminancia total de la fuente original. Por mucha lupa que le pongas al sol y colimes su haz (modifiques el ángulo), el resultado nunca tendrá más energía que la del propio sol. Por eso es imposible encender fuego concentrando la luz reflejada por la luna o por eso los proyectores AR tienen unas pérdidas de luz enormes. Siguiendo el dicho castellano: de donde no hay, no se puede sacar.

Y para hacerlo aún más complicado, en la AR solo importa la luz que llega a tus ojos (medido en nits = cd/m2 y en una dirección en particular), porque el resto será luz desperdigada que solo producirá pérdidas. Esa ley de la luminancia unido a este último detalle de concentrar luz justo en tus ojos, se traduce en la necesidad de instalar proyectores ultra compactos y ultra potentes, pero que a la vez no nos achicharren las sienes de la cabeza por el calor que disiparán a su alrededor. Un auténtico reto que puede llevar todo un siglo solucionar.

GAFAS GRANDES + PROYECTORES POTENTES = POCA BATERÍA

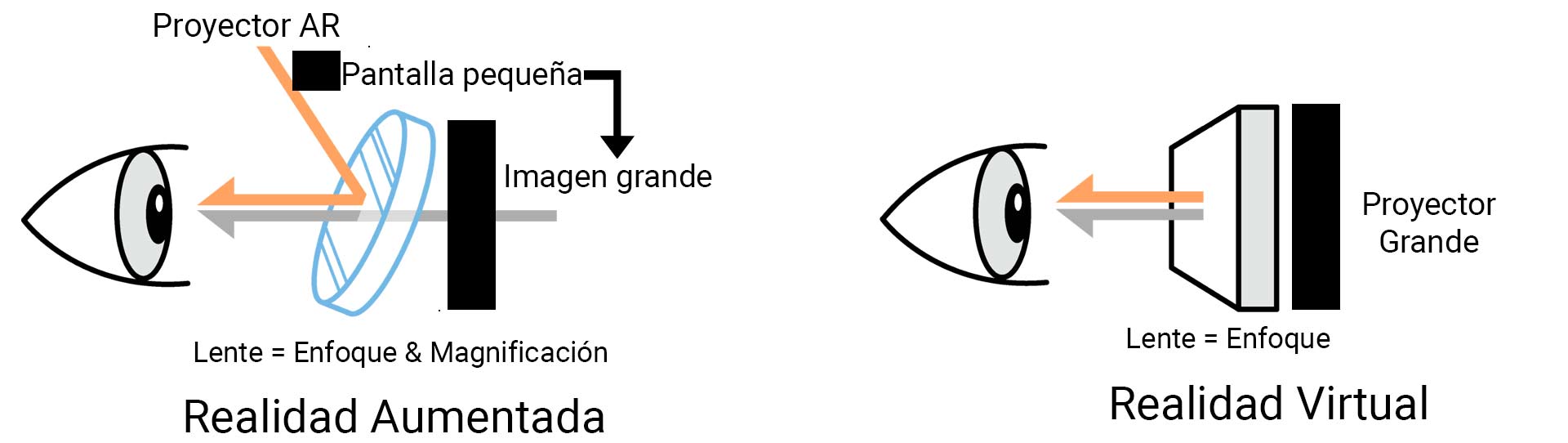

Por si esto fuera poco, el diseño de las lentes de Realidad Aumentada afronta otro desafío bastante inadvertido por el público general: mientras que en la Realidad Virtual la lente solo tiene que enfocar la luz que sale de una pantalla enorme hacia nuestros ojos, en Realidad Aumentada hay que añadir, además del enfoque, el aumento o ampliación de la imagen debido a las dimensiones tan pequeñas del proyector.

¿Resultado? Un imaginario (así llaman los ópticos a los sistemas que producen imagen) infinitamente más complejo que en la VR y propenso a sufrir todas esas aberraciones cromáticas y geométricas que tanto identificamos en la VR. Si llevamos desde 1956 tratando de solucionar la VR, como para pedir que la AR se arregle en menos de una década.

NREAL LIGHT

Llegamos entonces al enésimo intento de la industria AR de lidiar con todos estos problemas ópticos y darle, además, "apariencia" de unas gafas de sol al uso.

En Realidad Aumentada podemos agrupar la mayoría de los visores en dos grandes familias según su tecnología óptica:

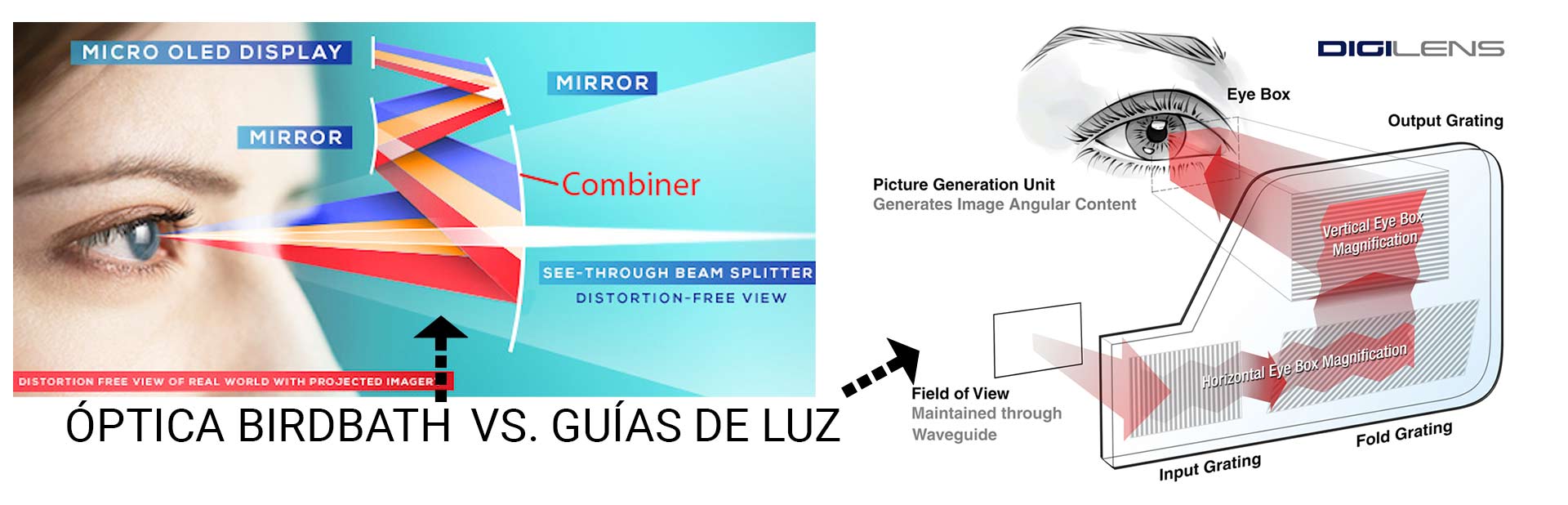

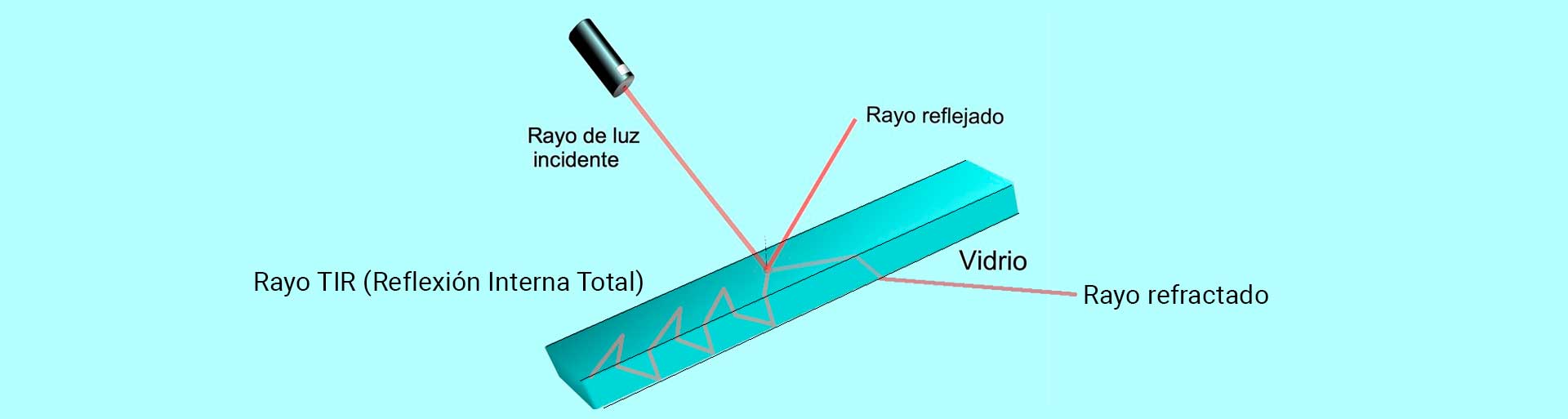

- Guías de onda (Waveguides)

- Combinadores (BirdBath)

En las guías de onda, un proyector diminuto inyecta la imagen en una esquina de la lente y este, gracias a muchas técnicas distintas, guiará la luz rebotando por el interior del cristal (TIR: Reflexión interna total) hasta la zona central que verán nuestros ojos. Entra por un lado, rebota siguiendo un camino y sale por otro. Hololens o Magic Leap utilizan esta técnica que es tan complicada de producir como cara de fabricar y tan fácil de renombrar según necesidades del marketing de ciencia ficción: desde falsos sistemas holográficos hasta campos de luz enviados a la retina pasando por cualquier otro nombre esotérico que solo busca confundir al usuario. Por desgracia, este sistema es tan complejo y tan lleno de problemas que los fabricantes aún andan buscando el santo grial.

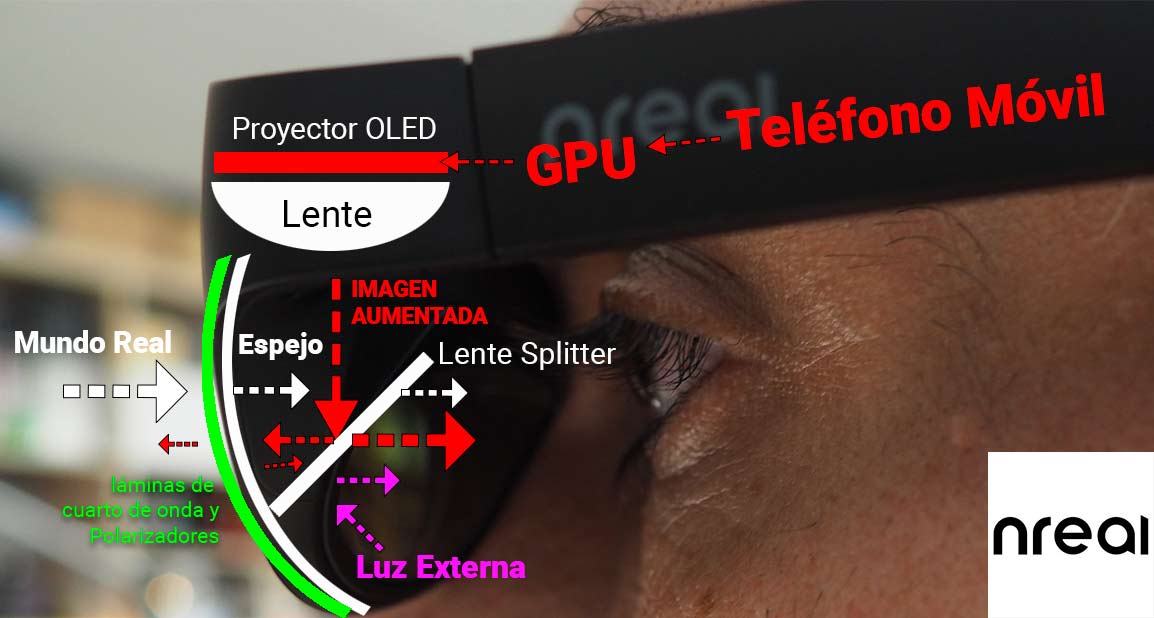

Nreal, en su caso, apuesta por una técnica bastante más barata que la anterior y muchísimo más sencilla: BirdBath. Un proyector emite la luz hacia un cristal semi "transparente"(llamado combinador) igual que si fuera una pantalla de cine. Así, la imagen del mundo real pasa a través del mismo cristal donde estamos proyectando la imagen y al conjunto, le llamamos Realidad Aumentada. En su camino encontraremos cristales polarizadores (cambios en la orientación de la luz), lentes splitters (divisores y multiplicadores), filtros a frecuencias determinadas... un puñado de capas "transparentes" y separadas entre sí que irán modificando la imagen sintética reflejada y refractada (la que rebota de vuelta y la que atraviesa el cristal) unido a la imagen del mundo real.

Los pros y los contras de cada tecnología -guías de luz y combinadores- dan para libros de texto universitarios de más de mil páginas, así que, en este primer análisis de un visor AR "comercial", no os sobrecargaremos demasiado los conceptos. Veamos en cambio cómo lidia Nreal con todos los límites tecnológicos de los que hemos ido hablando.

LA TÉCNICA BIRDBATH DE NREAL LIGHT

Vista por primera vez en la feria CES del 2019, este diseño en particular ha sido copiado por unos cuantos fabricantes desde entonces: Pacific Futures (AM Glass), el último modelo de Lenovo (ThinkReality A3), 0Glasses o el modelo de referencia de Qualcomm, por ejemplo.

El conjunto de la óptica se llama Birdbath. Un panel microOLED situado a la altura de la ceja emite la imagen a través de una lente que la aumenta, divide y polariza (Beam Splitter). Esta imagen aumentada y polarizada se envía a su vez contra una pantalla de cristal también polarizada (el cristal exterior de las gafas) y esa luz regresa a nuestros ojos mezclada con la imagen del mundo real que vemos a través del cristal exterior.

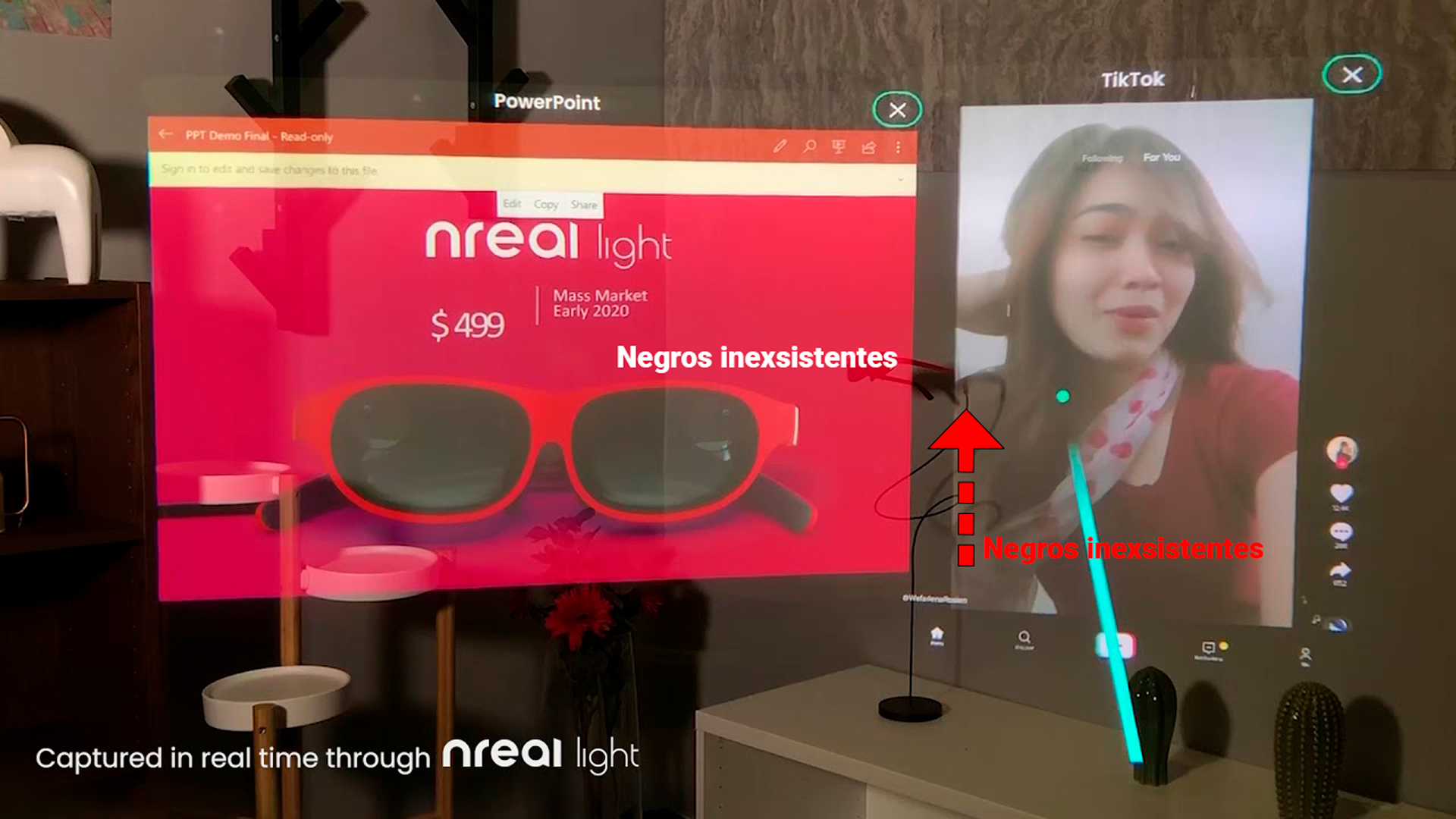

Por culpa de la ley de Etendue, el tamaño final del EyeBox (la zona donde nuestro ojo podrá ver algo) irá siempre en relación al tamaño del proyector y las lentes, y por culpa de la Ley de la Luminancia, mucha de la luz del proyector se perderá en el éter. El resultado es el esperado: un FOV pequeño (52º) comparado con la VR (100º) y una calidad de imagen lavada con poco contraste. Recordad que el color negro en AR no puede existir porque en realidad, carece de frecuencias. El negro es ausencia de luz y no existen linternas de "No luz". Así que el nivel de negro será el nivel de oscuridad del cristal, la pared o lo que tengas delante de las gafas AR.

COMBINADOR (CRISTAL). TAMAÑO Y TRANSPARENCIA. QUÉ SE VE DESDE FUERA

La serie de cristales polarizados (que afectan a la luz) y en diferentes ángulos necesarios para que la imagen llegue a nuestros ojos, obligan a que Nreal haya tomado varias decisiones importantes respecto a las lentes.

El primer afectado grave afecta a la "transparencia" del sistema de visión general. ¿Cómo mejoramos la calidad de visionado de un proyector en una casa o en el cine? Podríamos comprar un proyector más potente para que llegue más luz a nuestros ojos tras rebotar en la pantalla, o podríamos oscurecer el ambiente bajando las persianas. Nreal opta por la segunda: necesita tintar mucho las lentes exteriores para oscurecer el mundo real y que la luz del proyector llegue a nuestros ojos rebotada con energía (nits) suficiente. Según algunos estudios, por culpa de este oscurecimiento, Nreal nos estaría ocultando cerca de un 77% de la luz que llega del exterior.

La experiencia es parecida a llevar unas gafas de sol oscuras en el interior de una oficina. El corolario a este detalle nos lleva a otro de los límites insalvables a día de hoy: la AR en espacios exteriores y a plena luz del sol es prácticamente inviable a no ser que oscureciéramos tanto las lentes que prácticamente hablaríamos de una realidad virtual y no aumentada.

El tamaño del conjunto guarda relación con el FOV (campo de visión, o tamaño de la pantalla) y el EyeBox que el proyector + lentes es capaz de generar. Como ya hemos comentado, con la distancia a la que se encuentra el proyector del cristal y la Ley de Etendue, este FOV queda en unos 52º horizontales y 60º verticales con un Eyebox relativamente decente, aunque no impedirá que tengas que recolocar las gafas cada cierto tiempo para que tu posición del ojo caiga dentro del área del eyebox.

Volvemos a separar conceptos: Si el FOV es la cantidad de imagen que se genera, el eyebox es la zona (cono tridimensional) donde podremos poner nuestro ojo y ver ese FOV perfectamente. Tan importante es "lo que vemos" como "desde dónde lo vemos". Un eyebox diminuto convertiría un visor VR/AR en un micro/telescopio donde a poco que muevas el ojo o el visor sobre tu nariz, dejarás de ver la imagen.

Las lentes, cristales y combinadores refractan la luz que las atraviesa pero también la reflejan como si fueran espejos. Si bien esta función es indispensable para que la información llegue a nuestros ojos, se convierte en algo a evitar lentes afuera. La privacidad es un concepto clave cuando hablamos de información y que desde el exterior se pueda distinguir lo que ocurre en la pantalla de un visor aumentado no ayudará en nada a su expansión.

Nreal trata de mitigar la imagen emitida por el exterior de la lente polarizando de nuevo el cristal exterior. Debido al proceso de oscurecimiento de la lente, desde ciertos ángulos y a cierta proximidad es posible distinguir claramente lo que que el usuario está contemplando. De igual manera, por culpa de todos estos límites técnicos, será prácticamente imposible ver los ojos del usuario.

PROYECTOR. PANTALLA. TIPO. TAMAÑO Y POTENCIA.

El proyector de unas gafas AR no deja de ser igual que cualquier otro proyector al uso: una pantalla de dimensiones muy reducidas emite la imagen y esta se magnifica a través de las lentes hasta llegar a nuestros ojos.

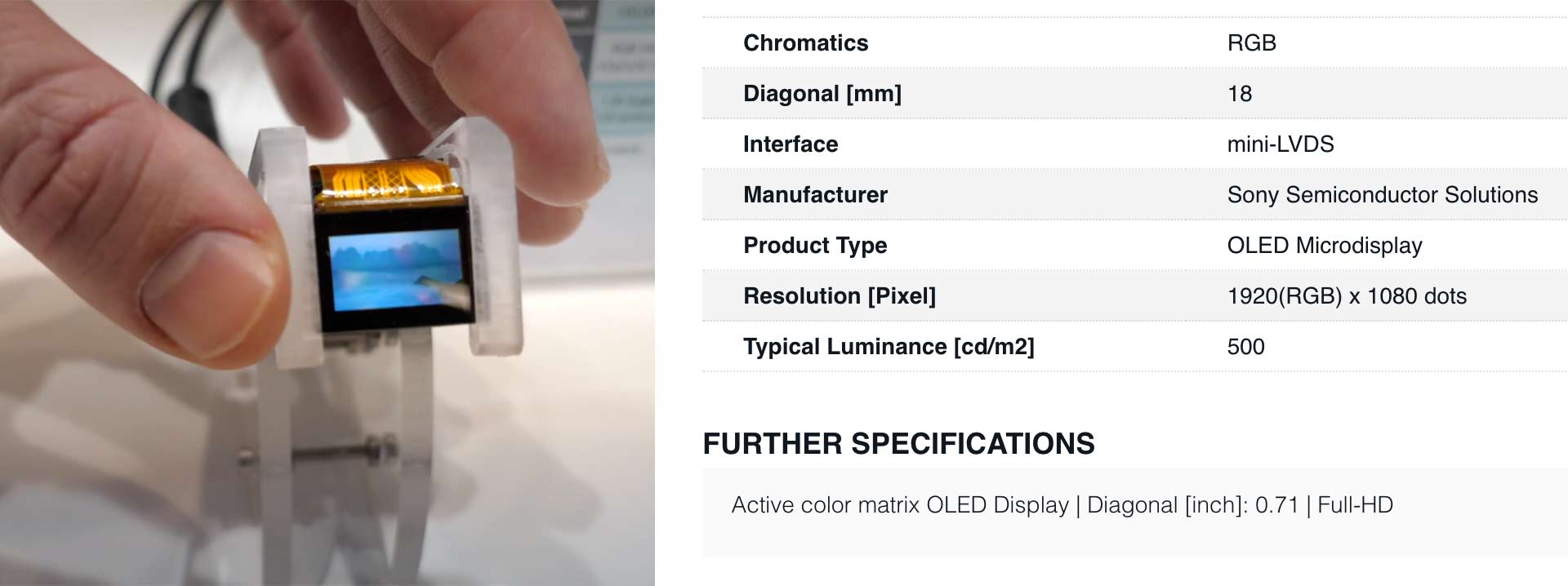

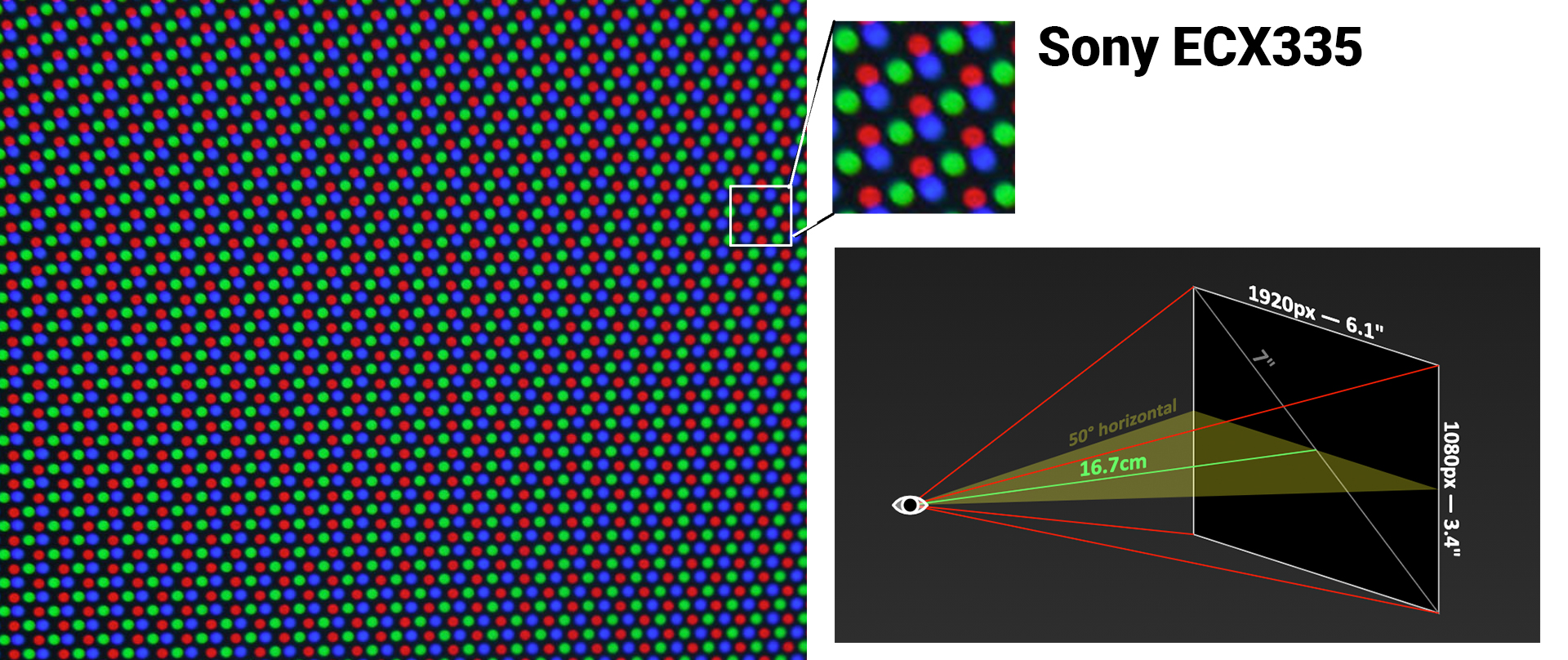

El panel que usa Nreal Light como proyector es un Sony ECX335 Micro-OLED de 1920x1080 pixels de resolución en una diagonal de 0.71 pulgadas. Este tipo de tecnología OLED es un estándar en los viewfinders de las cámaras de fotografía y similares. Siendo Sony una de las grandes suministradoras de paneles, no es de extrañar que esta tecnología se encuentre en una posición de viabilidad coste/producción excelente y muchas marcas de visores AR hayan decidido explorar este tipo de modelos.

Otro detalle crucial que diferencia la AR frente a la VR: los proyectores de luz son muchísimo menos eficaces que las pantallas. En Realidad Virtual tenemos una pantalla de unas 5 pulgadas emitiendo luz a pleno rendimiento solo a través de una lente y lo más importante, en un lugar cerrado. En realidad aumentada, el número de lentes es mucho mayor, el sistema es abierto y la pantalla es de menos de una pulgada.

Por tanto, la luz final que llegará a tus ojos (nits) en Nreal Light estaría en torno a una eficiencia máxima del 14%, sobre unos 120 nits. En la comparativa, Hololens 2 proyecta unos 400 nits y Magic Leap unos 210 nits. En los sistemas HUDs (heads-up display) de los coches o los aviones, por ejemplo, se usan valores mínimos de 15.000 nits para conseguir una visibilidad aceptable. Hablamos, una vez más, de luz directa a tus ojos. Si las pantallas, espejos o lentes reflejan solo un 20% o 30% de lo que emite el proyector, estaríamos hablando de una potencia original necesaria de unos 50K cd/m2. Estamos aún a años luz (nunca mejor dicho) de conseguir esa potencia y disipar el calor irradiado.

Tomando en cuenta estos detalles, la imagen que logra emitir Nreal a través de todos los cristales, mezclada con la imagen del mundo real, tendrá una luminancia pobre que necesitará de un fondo (pared o habitación) poco iluminada para verlo con una claridad mínima de lectura o visionado.

RESOLUCIÓN. FOV. EYEBOX. COLOR.

La resolución viene limitada por el panel. Cada píxel del Sony ECX335 se compone a su vez de 3 subpixeles (Rojo, Verde, Azul) en forma hexagonal y en disposición de triadas superpuestas. Estos 1920 x 1080 píxeles deben rellenar un FOV total de 52º. Teniendo en cuenta que la pantalla se encuentra a 16,7cm del ojo, da un valor de Píxeles por grado de 38.6 ppd en el centro y 42.1 ppd en los extremos.

La experiencia de visionado es aceptable. Con un FOV final tan pequeño (52º), los 1920x1080 crean una imagen nítida y muy limpia que permite la lectura de texto relativamente decente en distancias normales con un efecto screendoor (distinguir los píxeles a simple vista) muy ligero y bastante más diferente a lo que estamos acostumbrados en VR. En ningún caso podremos trabajar con textos pequeños y muy alejados pero la lectura de páginas web y PDFs es viable.

A estas alturas, todos estamos muy escarmentados ya con las aberraciones y desviaciones en el color de los visores virtuales. Como marca la física óptica, cada lente o filtro que se incorpora a un sistema degradará la visión final en un porcentaje (además de aumentar el etendue y perder energía), y en la realidad aumentada estas deformaciones y aberraciones, por desgracia, nos van a acompañar durante varias generaciones más.

En Nreal Light, la aberración cromática (separación de los colores RGB en los bordes) es evidente en todo el perímetro de la imagen. También lo es en aquellos detalles pequeños tales como fuentes escritas o elementos de menús de pocos píxeles de grosor incluso dentro de la superficie del EyeBox. Además, el ghosting (estelas de los objetos) muy visible cuando se mueve la cabeza, refuerza la sensación de que la pantalla no termina de renderizar a un refresco suficiente para mitigar o eliminar estos errores.

Como ya hemos comentado, por los límites de la tecnología aumentada de proyección, los negros brillarán por su ausencia. Como solución, Nreal ofrece una tapa ciega completamente opaca que convierte las Light en un visor virtual sin ninguna transparencia del mundo real.

El uso de este añadido permite, por ejemplo, el visionado de contenido multimedia o la lectura de documentos en ambientes de mucha luz. Si bien la tapa bloquea la luz directa, el diseño abierto de Nreal permite que la luz exterior entre por todos los ángulos laterales, creando reflejos que podrían molestar. Por contra, y al contrario que en los visores de VR al uso, esta apertura tan grande se siente como un término intermedio entre los dos mundos.

PESO Y FORM FACTOR

Una vez más, el marketing pretende vender su propia visión particular de la realidad. Nreal quiere ser unas gafas de sol inteligentes donde el resto veremos un equipo que se queda en un valle inquietante. Parecen unas gafas al uso pero una vez puestas, las limitaciones de forma para albergar todo el sistema óptico obliga a una separación antinatural de lo que se supone sería un diseño de gafas normales. ¿Es mejor intentar parecer algo que no es para llegar a más público (Nreal ó Magic Leap) o dejar de aparentar normalidad y hacer algo diferente (Hololens)?

El cable USB-C que conecta las gafas al terminal móvil sale de una de las patillas de manera elegante, pero añade cierto peso asimétrico que el conjunto del sistema no logra equilibrar por completo.

Para que el marco de las gafas descanse en el puente de la nariz, Nreal ofrece 4 piezas diferentes según el tipo de facial que tengamos. En nuestro caso, elegimos una que minimizaba la sensación incómoda de notar como las gafas se iban escurriendo hacia adelante con el peligro de caerse en un movimiento más brusco.

La experiencia de uso con las Nreal Light puestas es contradictoria. Igual que en los comienzos de la realidad virtual donde el equilibrio del visor y el punto dulce mezclado con el FOV (o mejor, la zona eyebox) obligaba a mover mucho el visor para ajustarlo a la zona de mejor visión, en Nreal nos volvemos a encontrar con la misma rutina: el movimiento natural de la cabeza tiende a descolocar las gafas obligándonos a recolocar el marco de nuevo.

Con un peso de 114 gramos sin el cable, no resulta demasiado incómodo una vez puesto. Eso sí, la inercia del peso hará que los movimientos de cabeza desplacen el eje de equilibrio y obligará a recolocar el visor cada cierto tiempo.

Las marcas de uso reflejan donde se apoya el mayor peso del marco, cerca de la frente y rodeando el puente de la nariz.

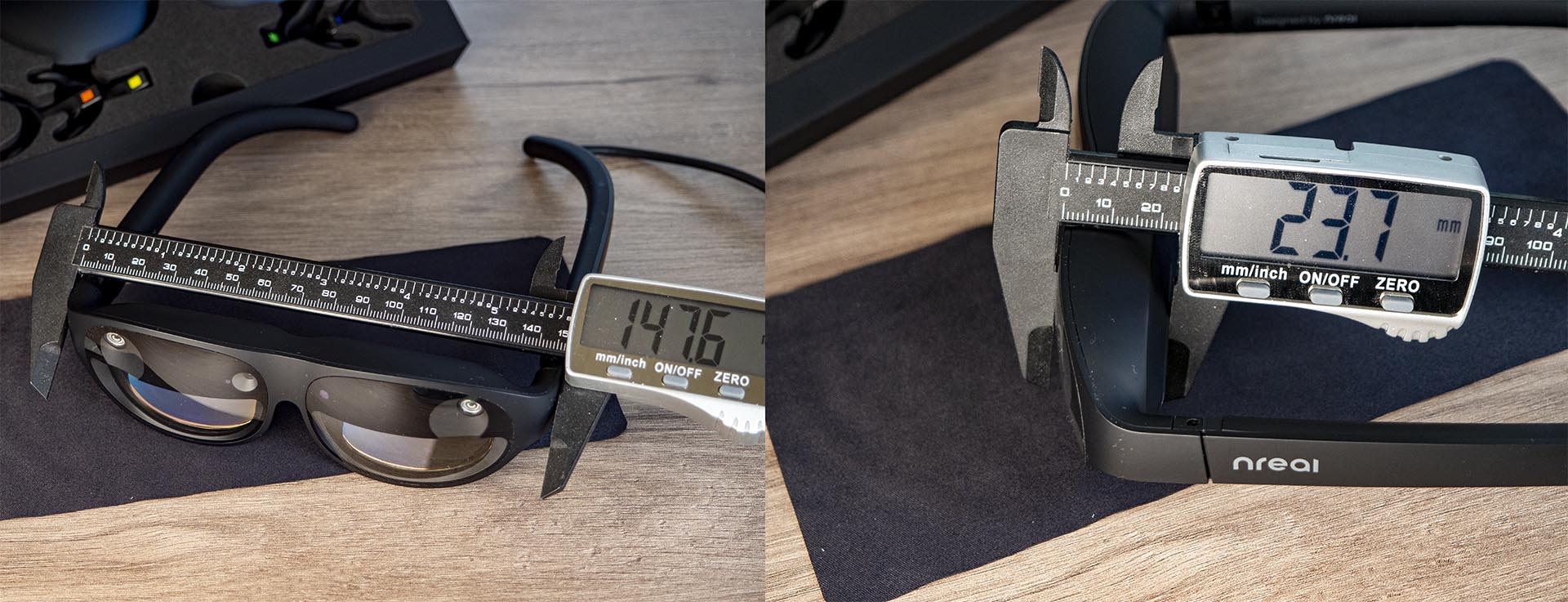

Con unas dimensiones que intentan asemejarse a unas gafas de sol modernas, Nreal se queda en 147mm de largo y 23.7mm en la zona de la lente.

La comparación directa entre unas gafas de sol y las Nreal es pertinente por la intención de la marca. Queda en evidencia lo lejos que está aún el diseño aumentado en miniaturizar todo el sistema hasta dejarlo en -más o menos- las dimensiones que el público en general espera.

CÁMARAS EXTERNAS - TRACKING

La realidad aumentada necesita "reconocer" el mundo que tiene alrededor para el posicionamiento absoluto. ¿Qué quiere decir posicionamiento absoluto? Saber la posición del usuario respecto a su mundo en todo momento. Por ejemplo, si decidimos colocar una ventana flotante con YouTube sobre una pared y que esta pantalla se quede fija en esa coordenada sin importar hacia dónde miramos o hacia dónde estamos andando, el sistema "espacial" necesita escanear nuestros alrededores para sacar puntos de referencia (SLAM).

Mallado de puntos de referencia calculado en tiempo real.

Las cámaras de AR hacen el mismo trabajo que las cámaras incluidas en los sistemas de VR Standalone: realizan un mapa en tiempo real de todos los objetos que nos rodean y usan esas coordenadas para posicionar y localizar luego toda aquella información que el usuario decida colocar. Además, según los sistemas de reconocimiento en la nube (Google Cloud) vayan nutriéndose de objetos escaneados, el software será capaz de reconocer más formas y los desarrolladores podrán ofrecer servicios asociados a estos objetos reconocidos sin necesidad de códigos QR (desde información sobre monumentos, instrucciones de uso, cambio de skins en tiempo real...)

Una vez obtenidos estos puntos de referencia (SLAM) , el sistema de tracking de Nreal Light funciona como se debe, sin ruido de coordenadas (vibración de la imagen) ni fallos obvios en el seguimiento de cabeza (si giras la cabeza, todo sigue donde se espera). El tracking del controlador, en este caso el teléfono móvil, está limitado exclusivamente a 3DOF (tres grados de libertad: izquierda y derecha, arriba y abajo), sin registrar el movimiento de profundidad (adelante y atrás).

Aún así, recordad que aunque los fundamentos del tracking son iguales a los de la Realidad Virtual, en la Realidad Aumentada tendremos una referencia directa del mundo real donde se posicionan los objetos simulados y por tanto, la exigencia percibida al posicionamiento de los objetos sintéticos en un escenario real será siempre mayor.

Más allá del uso sobre cómputo espacial de escaneado y reconocimiento, Nreal Light dispone de una cámara RGB (color) con capacidad de capturar vídeo o realizar fotografías del mundo real. Al contrario que las gafas de Facebook/Rayban, Nreal no parece haber incluido ningún tipo de led de información que muestre si se está realizando una captura de video. De nuevo, el tema de la privacidad en el mundo aumentado genera el tan obligado como necesario debate.

CPU y BATERÍA

La miniaturización de componentes en 2021 está muy avanzada, sin embargo, aún no se ha podido meter un ordenador completo y potente dentro de las patillas de unas gafas de sol. Además, el sistema de cómputo (gráfico y de proceso) sigue disipando muchísimo calor. Por tanto, desde Nreal, igual que Magic Leap y otros muchos fabricantes, apuestan por extraer del marco de las gafas todo lo relacionado con el cálculo.

En la versión comercial de su Nreal SDK que funcionaba con un dispositivo externo (Qualcomm SnapdragonTM 845 SoC) y sin pantalla alguna, Light ofrece la posibilidad de funcionar con una cantidad muy variada de teléfonos de categoría superior como la familia de Samsung NOTE 20, Galaxy 21 o en nuestro caso, un Oppo XR Pro ofrecido por Vodafone.

Como bien sabemos los aficionados a la realidad virtual, el uso de teléfonos móviles como cerebro del sistema y batería general estuvo presente en los primeros años de la vida de la VR (GearVR + Samsung S6). Lamentablemente, en AR, los pros de esta decisión como son la disipación del calor alejada de la cabeza del usuario, el menor peso de los componentes o un tamaño mayor de la batería, añaden unos contras muy difíciles de asimilar. A la presencia de un cable de conexión entre gafas y móvil y a la obligación del uso del terminal móvil del usuario con el gasto de batería global, implica, además, la compra de un terminal de última generación, elevando muchísimo el precio final del conjunto.

¿Habría sido mejor incluir un terminal dedicado como sí hace Magic Leap o Hololens 2? Desde el comienzo de la VR móvil, John Carmack (ideólogo del hardware que muchos usamos en la actualidad) se ha venido quejando de los límites que los fabricantes de móviles ponen en los SDK de sus chips. No es lo mismo optimizar un sistema dedicado y fabricado ex profeso al uso de diferentes versiones de móviles diferentes entre sí y con la mayoría de las funciones más importantes cerradas a los desarrolladores. En la VR, el uso de los móviles arrojó más sombras que luces y son millones de usuarios los que actualmente siguen pensando que la Realidad Virtual se quedó estancado en aquello que vieron a través de las pantallas de sus teléfonos.

Nuestro Nreal llegó acompañado de un Oppo X3 Pro 5G con las siguientes características:

- Qualcomm Snapdragon 888 Mobile Platform

- Velocidad de CPU: 1 x 2.842 GHz/3 x 2.419 GHz/4 x 1.786 GHz

- Número de CPU Cores: 8 cores

- Modelo de GPU: Adreno 660

Tras la experiencia de muchas aplicaciones AR (gráficamente muy poco demandantes, sencillas y muy "demo"), creemos que el chipset, de momento, va sobrado. Si bien el modelo 888 de Qualcomm es más moderno que el Snapdragon XR2 (dos cores más y 8gb más de RAM) y su GPU algo más potente, la posibilidad de optimización que le da a un fabricante montar su propio chipset (XR2) frente al uso de un sistema Android cerrado, marca muchísimo la diferencia.

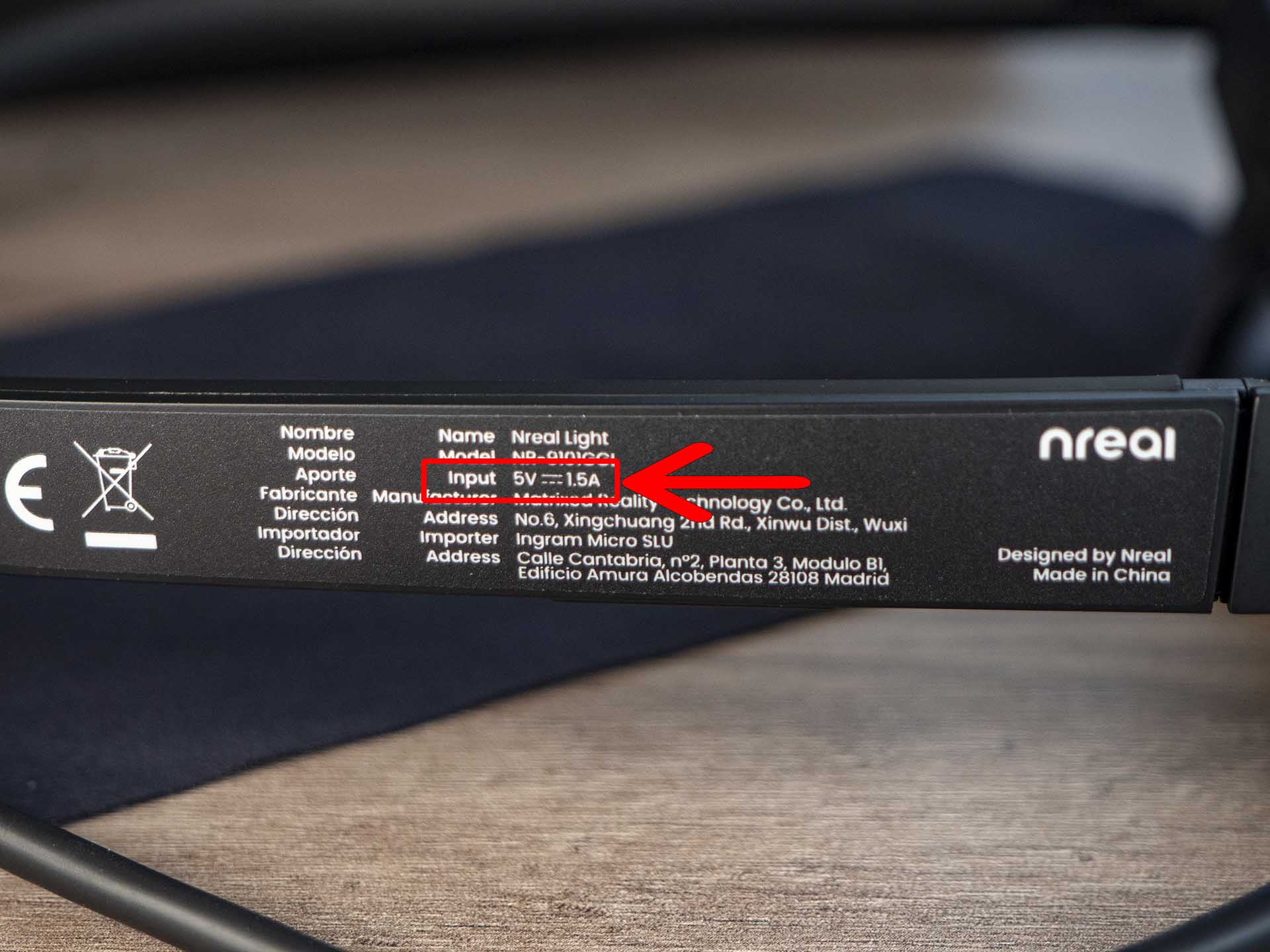

La batería que monta el modelo Oppo X3 Pro está formada por 2 celdas de 2200 mAh. El consumo de 1.5A a 5V máximo, arroja un rendimiento de unas cuatro horas de visionado multimedia sin el uso de datos 4G/5G y de dos horas de aplicaciones gráficas. Suponemos que este tiempo se rebajará notablemente con la activación de datos en redes 4G/5G.

CONTROL

En otra decisión muy difícil de asimilar por parte de Nreal, el control de las aplicaciones y la interacción con la AR se realizará mediante el propio teléfono móvil. La aplicación Nebula convierte la pantalla del teléfono en los botones del ratón y el propio terminal en un controlador 3DOF del que sale un láser puntero virtual visible solo a través de las Nreal.

Los inconvenientes son enormes desde un punto de vista práctico: una pantalla siempre encendida con el calor y el gasto de batería asociado además de lo incómodo de manejar en el aire un terminal bastante grande y pesado. Sabemos que Nreal sigue trabajando en el reconocimiento de gestos de manos pero a día de hoy, la única manera de utilizar las Nreal Light es mediante el terminal.

Además del teclado, Nreal cuenta con un botón para controlar el volumen y realizar acciones esporádicas con las aplicaciones que así hayan sido programadas. El botón se encuentra en la zona baja de la patilla y queda oculta en el visor.

Siguiendo el mismo diseño que Oculus Quest y otros visores virtuales, el sonido de Nreal llegará hasta el usuario a través de una abertura situada en ambas patillas. Como todos sabemos, estas aberturas se integran perfectamente con el diseño general, pero la calidad que ofrecen es bastante ajustada, tanto en calidad como en potencia.

ECOSISTEMA Y APLICACIONES

El sistema de interfaz gráfico de Nreal basado en Android se llama Nebula. Una capa de software de control que sirve de pasarela para todas las posibles aplicaciones compatibles con la AR, desde aquellas dedicadas hasta las aplicaciones 2D más comunes tipo YouTube, Chrome o similares.

La capa de personalización es bastante limitada y funcional. Los iconos, flotando en el centro de tu visión, se agrupan en funciones y tal y como ya hemos apuntado, será con el puntero del móvil donde realizaremos las interacciones.

Nreal llega con varias propuestas AR internas a modo de demo, un puñado reducido de aplicaciones sencillas de terceros y algún que otro desarrollo interno de la propia Vodafone, la encargada de traer a España este visor aumentado. Si bien el manejo del ecosistema es intuitivo, las aplicaciones son tan sencillas y tan poco productivas que la mayoría del uso que le hemos dado ha sido como segundo monitor (conectando el USB-C al PC o Mac) o como representación de pantallas 2D en el espacio de habitación.

Durante el mes en los que hemos tenido el dispositivo, el mayor de los usos que le hemos dado ha sido como reproductor multimedia de YouTube y plataformas de streaming. La posibilidad de anclar aplicaciones 2D a tu alrededor fue bastante más cómodo y sugerente de lo que en un principio podría parecer.

CONCLUSIÓN

A un año de que Facebook y Apple puedan dar comienzo a sus propios juegos aumentados y definan las reglas de lo que será el futuro de la sociedad asistida, Nreal Light es producto valiente en su propia concepción de la AR. Valiente, pero también muy osado. El fiasco supremo (y vaticinado) de Magic Leap, supuso un tiro en el pie a toda la tecnología XR (VR & AR) propiciado por la publicidad engañosa de promesas imposibles. Por eso Nreal nos parece una apuesta casi heroica en un ecosistema tan frágil y condenado -por propias decisiones- a sobredimensionar las capacidades técnicas.

La tecnología birdbath es mucho más barata que cualquier otro invento aumentado y el resultado encara con ciertas garantías lo que es posible conseguir a día de hoy. La calidad del visionado, aunque no exenta de aberraciones cromáticas y geométricas, cumple con su propósito y se acerca a lo máximo que se puede hacer con la tecnología actual. Sin embargo, Light falla en su intento de parecerse a lo que todo el público tiene en mente como gafas aumentadas. Nreal Light se queda en un objeto extraño y grande para lo que insinúa ser.

Las aplicaciones, inexistentes aún en el ecosistema de la AR de visores (no de telefonía), tampoco ayudarán a su expansión más allá de las demos de empresas y posibles usos muy industriales. Lejos de servir como una plataforma de juegos, la AR necesita volverse indispensable para que su adopción sea masiva. Primero, sustituyendo el teléfono móvil. Segundo, añadiendo una capa customizada a la realidad. Como hemos tratado de explicar en este análisis, ninguna de las dos opciones son viables con el hardware óptico de esta generación. Queda mucho, por tanto, para llegar a la Hyper-Realidad que profetizó Keiichi Matsuda y que una parte de la población sigue creyendo posible por culpa del marketing.

Facebook y Apple parecen haber aprendido de los errores anteriores (Magic Leap) y todos sus anuncios van en la misma dirección: nuestros visores no serán aumentados, sino asistidos. Harán poco y lo harán muy enfocados a una tarea en particular. Crearemos aplicaciones útiles para el día a día, llevaremos algunas opciones del teléfono a la gafas y en general, ofreceremos poco para mantener el coste y los tamaños al mínimo.

Hasta que llegue ese día, Nreal Light es un intento muy digno de domar la ciencia aumentada y una ventana a lo que en un futuro podrá ser la customización de la realidad. Por desgracia, y aunque sin pretenderlo, Nreal Light también sirve como ejemplo de los límites técnicos a los que se enfrenta la AR actual.

Queremos agradecer a Vodafone y a Nreal la unidad que nos han prestado y les deseamos a ambas mucha suerte en la carrera por ver quién pone un visor aumentado en las caras de todos los millones de usuarios potenciales.

ray_manta

Visores

#51 » Respuesta a cercata #49 24 SEP 2021 13:31

En ROV conocíamos el modelo BT-100 y el BT-200, y ya van por el BT-300 o más por lo que parece. Habrá que investigar cómo son esas nuevas Epson BT-350.

www.realovirtual.com/noticias/270/epson-presenta-las-gafas-realidad-aumentada-moverio-bt-200

cercata

Visores

#52 » Respuesta a ray_manta #51 24 SEP 2021 13:43

Un compi del curro ha probado unas, aunque no me sale decir que modelo, y parece que les han convencido y las van a comprar para mantenimiento remoto. Dice que se veia bastante bien en una sala con luz tenue

Hay varios modelos actualemete, tambien estan las BT-35E, BT-2000 y BT-2200, pero por el precio yo creo que ha probado las BT-350

Lo que pasa es para uso recreativo, esos 23º se quedan bastante cortos ... asi que supongo que ese es el talon de aquiles de la tecnologia que usan, ya que llevan 7 años con el mismo FOV por lo que veo en ese articulo de 2014.

Hay una empresa española que vende soluciones basadas en ellas, por si quereis permutarles un dia por Twitch:

https://www.innovae.eu/

edusuko

Visores

#53 30 SEP 2021 13:17

Excelente reportaje. Ojalá sea un "ojalá me equivoque" más...

tonino65

#54 » Respuesta a edusuko #53 5 NOV 2021 13:20

Hola, ya voy por la tercera unidad de las nreal light. Tengo un problema en todas, en MR al cabo de un tiempo se bloquean, el puntero y la imagen quedan bloqueados, hay que volver a conectarlas. No sé si es por calentamiento o fallo de la conexión 5G.Me gustaría contactar con alguien que las utilice o le suceda lo mismo. Dejo mi correo:

tonicaparros4@gmail.com

Gracias