Facebook comparte más información sobre la tecnología de posicionamiento Insight de Oculus

22 AGO 2019 16:00

Dos artículos sobre el sistema de tracking Oculus Insight que integran sus nuevos visores y que sienta las bases para los futuros dispositivos de realidad aumentada.

Facebook ha compartido dos artículos acerca de la tecnología de visión artificial SLAM y de cómo la aplicaron para crear su sistema de posicionamiento absoluto Oculus Insight, que encontramos en sus nuevos visores Rift S y Quest. El primer artículo trata el problema y la solución alcanzada, y el segundo se sumerge más a fondo en el funcionamiento de dicha tecnología, que es transparente en el rendimiento de los juegos y aplicaciones, pues se ejecuta en los "núcleos Silver de 1,9 GHz de bajo consumo" de Quest, algo que ya anticiparon antes del lanzamiento del dispositivo. Ambos artículos concluyen que esta tecnología abre las puertas a su aplicación en visores de realidad aumentada.

A continuación os ofrecemos la traducción íntegra de dichos artículos:

Del laboratorio a tu casa: la historia de la tecnología Oculus Insight de Facebook y la nueva era de la RV de consumo

Cuando Anna Kozminski se incorporó a Facebook como gerente de programas de software en 2018, su misión estaba clara: contribuir a eliminar esta atadura de los dispositivos de RV para que cualquiera pudiera ponerse un visor y zambullirse de inmediato en la realidad virtual, sin necesidad de configurar cámaras de rastreo externo para capturar sus movimientos.

"Queríamos crear un sistema que permitiera moverse y explorar un mundo de RV con la misma naturalidad y facilidad que en la vida real", afirma Kozminski.

Kozminski pasó a formar parte de un equipo cuya misión era crear el primer sistema de rastreo "de dentro a fuera" (inside-out) con todas las funcionalidades para un dispositivo de RV de consumo. La tecnología debía rastrear todo el rango de movimientos de una persona (conocido como los "seis grados de libertad") y ser capaz de identificar la ubicación de los dos controladores y del casco.

Anteriormente, los dispositivos de RV recurrían a sensores externos para rastrear estos movimientos. Estas cámaras se conectan al ordenador y, pese a que funcionan bien, hacen que la RV sea menos portátil y más difícil de configurar.

"Con el rastreo inside-out en el visor, la RV pasa a ser un gesto tan sencillo como ponerse unos auriculares para escuchar música", afirma Kozminski.

Pero la misión del equipo era muy compleja: debían llevar la puntera tecnología de visión artificial de los laboratorios de investigación y hacer que funcionara en un dispositivo de consumo que cualquiera pudiera usar. El seguimiento debía tener una precisión milimétrica, lo suficiente para capturar una sutil inclinación de la cabeza o un gesto con la mano. Tenía que ser lo suficientemente robusto como para funcionar en la infinidad de condiciones que pueden darse en los hogares del mundo real. Y tenía que ser lo suficientemente eficiente como para funcionar en un dispositivo con batería como Oculus Quest.

Para ello, Kozminski y su equipo recurrieron a la visión artificial (un subcampo de la investigación sobre inteligencia artificial) y algoritmos manuales para generar un mapa 3D en tiempo real del entorno inmediato de modo que el casco pudiera calcular la posición en el mapa y trasladarla a la RV.

Denominamos a este sistema Oculus Insight, el artífice de nuestros nuevos visores Oculus Quest y Rift S. Y hoy te desvelamos cómo un equipo de ingenieros ubicados en Zúrich, Menlo Park y Seattle dieron forma a esta tecnología.

Partir de la tecnología SLAM…

El rastreo de dentro a fuera de Oculus Insight se basa en la localización y el mapeo simultáneos, o SLAM, que utiliza algoritmos de visión artificial para, fundamentalmente, fusionar los datos procedentes de varios sensores con el fin de determinar la posición de un objeto en un mapa digital que se actualiza constantemente. La tecnología SLAM se ha utilizado en robótica y en efectos de cámara de RA en smartphones, y se introdujo en versión demo en el prototipo de casco de RV Oculus Santa Cruz en 2016. Pero Oculus Insight requería un nivel de precisión y eficiencia sin precedentes, y esto conllevaba adaptar las últimas investigaciones sobre rastreo y visión artificial.

"Gran parte de estas tecnologías comienzan realmente en el ámbito académico, en un laboratorio", apunta Kozminski. Por tanto, no es de extrañar que forme parte del equipo de ingenieros de Facebook ubicado en Zúrich, muchos de los cuales provienen de Zurich Eye, un programa conjunto de la prestigiosa ETH University y de la Universidad de Zúrich centrado en la investigación de sistemas de autonavegación.

Para crear una nueva versión más avanzada de SLAM, el equipo de ingeniería se basó en los años de investigación de Facebook dedicados a la IA y a trabajos de ingeniería, desarrollando sistemas para entender los objetos y las acciones que aparecen en los vídeos y crear algoritmos de visión artificial sumamente eficientes que funcionen bien en dispositivos móviles.

…y hacerla funcionar con innovadores dispositivos de RV

Oskar Linde, el arquitecto principal de percepción automática del equipo de Facebook que trabajó en Oculus Insight, ya tenía experiencia en el desarrollo de sistemas SLAM ultraeficientes. Linde fue cofundador de 13th Lab, una startup que logró utilizar por primera vez la tecnología SLAM visual en una aplicación de consumo en el marco de un juego de RA móvil en el año 2011. Cuando Facebook adquirió 13th Lab y su tecnología SLAM en 2014, Linde se incorporó a la compañía para desarrollar una tecnología de rastreo independiente de dentro a fuera para cascos de RV, formando así el equipo que inició el desarrollo continuo de Oculus Insight.

En 2017, el equipo de Oculus Insight avanzaba a velocidad de crucero, pese a enfrentarse a un gran reto: crear una tecnología de rastreo basada en SLAM que fuera extremadamente precisa, pero que fuera lo suficientemente eficiente como para integrarse en un dispositivo portátil como el Oculus Quest. Linde contó con la ayuda del gerente de Ingeniería Joel Hesch, que anteriormente había estudiado las aplicaciones de SLAM mediante sensores visuales, láser e inerciales para contribuir a la navegación robotizada, y además había trabajado con aplicaciones móviles de RA y RV. Hesch se incorporó a Facebook para dirigir el equipo que trasladaría Oculus Insight a Quest y Rift S.

Linde, Hesch, Kozminski y su equipo se basaron en el trabajo previo de Facebook sobre SLAM para uso de RA en dispositivos móviles, así como en la tecnología de rastreo presente en el sistema original de RV de Oculus Rift, pero tuvieron que estudiar nuevas vías de cara a adaptarlos y rediseñarlos para el rastreo de dentro a fuera en cascos de RV.

En un smartphone, SLAM utiliza la cámara del teléfono para crear efectos de foto y vídeo "anclados". Pero con la RV, existen varias cámaras, sensores adicionales y tres objetos diferentes para rastrear en un espacio tridimensional.

"Tenemos tres piezas en movimiento a la vez: el casco y dos controladores adicionales", comenta Kozminski. "Debemos registrar siempre esa posición con absoluta precisión".

También existen otras complicaciones. Los LED infrarrojos de los dos controladores manuales cambian drásticamente de aspecto cuando se acercan o alejan del casco mientras esgrimes una espada virtual o pilotas una nave espacial. Oculus Insight también utiliza otros sensores, que extraen datos sobre aceleración y velocidad de las unidades de medición inercial (IMU) situadas en el casco y en los controladores. El sistema debe procesar todos estos datos en tiempo real y, en el caso de Quest, en un chipset móvil.

Precisión milimétrica

Para abordar todos estos desafíos, el equipo de Oculus Insight perfeccionó metódicamente su sistema. Desarrolló nuevos algoritmos de visión artificial para potenciar la precisión y la velocidad de rastreo del sistema. Grabaron miles de horas de vídeo en una amplia gama de entornos de muestra y, a continuación, utilizaron el material para enseñar al sistema a identificar las características en su entorno. Al identificar y rastrear, por ejemplo, las esquinas de un sofá o el borde de una mesa, Oculus Insight puede triangular la ubicación exacta de una persona en una habitación, en tiempo real; parecido al modo en que nuestros ojos detectan objetos para que nos podamos orientar.

El equipo también utilizó un conjunto de cámaras de captura de movimiento OptiTrack sumamente precisas, las mismas que se usan en las producciones de efectos visuales de Hollywood. Al comparar las mediciones registradas con las cámaras OptiTrack con los datos de Oculus Insight, los ingenieros fueron capaces de perfeccionar los algoritmos de visión artificial del sistema para ajustar su precisión al milímetro.

Trabajar en el plano matemático -y humano- para lograr la mejor experiencia de RV posible

Aunque el enfoque en un laboratorio de investigación es lograr resultados cuantificables, precisos y replicables, el hecho de tener en cuenta a las personas que usarían esta tecnología en su día a día conllevó cambiar el enfoque a la métrica perceptual. Dicho de otro modo: ¿cómo percibe la persona una determinada experiencia dentro de la RV?

Para abordar sensaciones perceptivas como el mareo (la sensación de desorientación que se tiene cuando las posiciones física y virtual y los movimientos de la persona no están alineados) y los temblores de imagen (destellos visuales y manchas entre fotogramas) el equipo de ingeniería tiró de creatividad.

El equipo de Zúrich dedicó muchísimo tiempo y energía a realizar comprobaciones de Oculus Insight con el sistema de captura de movimiento OptiTrack en distintos ambientes y en diferentes condiciones haciendo ellos mismos de sujetos de prueba.

Llevar el rastreo de dentro a fuera más allá de la RV

Hoy en día, Oculus Insight facilita como nunca antes la experiencia de la RV para las personas. Con Rift S, solo tienes que conectar el visor al ordenador, sin necesidad de más cables o conexiones. Quest prescinde por completo del ordenador para ofrecer experiencias increíbles en la habitación sin necesidad de configuración. Pero nuestra visión de futuro va más allá de los límites que conocemos hoy.

La misma tecnología que actualmente se integra en Oculus Insight (así como las experiencias de RA en Facebook, Instagram, Messenger) se traducirá, en última instancia, en nuevas experiencias en dispositivos del futuro. En su momento, será la base para crear gafas de RA ligeras y estilosas.

Aún nos queda mucho por hacer, pero con Oculus Insight, estamos un paso más cerca.

Oculus Insight: pura IA

Para poder aprovechar plenamente el potencial de las experiencias de realidad virtual (RV) y de realidad aumentada (RA), la tecnología debe funcionar en cualquier lugar, adaptándose a los espacios donde vivimos y a nuestra forma de movernos en estos entornos reales. Cuando desarrollamos Oculus Quest, el primer sistema de RV para gaming totalmente integrado y sin cables, sabíamos que necesitábamos que el rastreo de posición fuera preciso, exacto y que estuviera disponible en tiempo real, en el marco de un visor autónomo, lo que implica que debía de ser compacto y tener un consumo de energía eficiente.

En el evento Oculus Connect del año pasado, compartimos algunos detalles sobre Oculus Insight, la tecnología de vanguardia integrada tanto en Quest como en Rift S. Ahora que ambos productos están en el mercado, queremos profundizar en los sistemas y técnicas de IA que hacen posible esta tecnología de RV. Oculus Insight ha permitido por primera vez que un sistema de rastreo con visor y controladores sin cables y con seis grados de libertad (6DoF) se integre en un dispositivo de RA/RV de consumo. Construido desde cero, el bloque Insight se sirve de innovadores sistemas de visión artificial (VA) y localización y mapeo simultáneos visuales-inerciales (o SLAM).

Oculus Insight calcula una posición precisa y en tiempo real para el casco y los controladores cada milisegundo para trasladar tus movimientos precisos a la RV, para que realmente sientas que estás ahí. Utiliza el SLAM para rastrear la posición del visor del usuario, así como la técnica de rastreo de constelación para realizar un seguimiento de las posiciones de los controladores. Los sistemas de VA de Insight fusionan datos procedentes de múltiples sensores del casco y los controladores para potenciar la precisión, exactitud y tiempo de respuesta del rastreo de posición del sistema.

Generar mapas en tiempo real y rastreo de posición con SLAM visual-inercial

Hace varias décadas que se vienen realizando investigaciones académicas sobre técnicas de SLAM, pero no ha sido hasta hace poco cuando esta tecnología ha alcanzado la madurez suficiente como para integrarse en aplicaciones de consumo, como vehículos sin conductor y aplicaciones móviles de RA. Facebook ya lanzó una versión del SLAM para RA en dispositivos móviles, que utiliza una única cámara y una unidad de medición inercial (IMU) para rastrear la posición del teléfono y permitir contenido anclado, es decir, vinculado visualmente a objetos reales. Oculus Insight es la segunda generación de esta tecnología, e incorpora mucha más información a partir de una combinación de varias IMU y cámaras de gran angular, así como LED infrarrojos para rastrear conjuntamente la posición 6dof de un visor de RV y de los controladores.

El sistema Oculus Insight utiliza una arquitectura de hardware personalizada y algoritmos de visión artificial avanzados -incluido mapeo visual-inercial, reconocimiento de lugares y reconstrucción geométrica- para determinar la ubicación de los objetos en relación con otros objetos dentro de un espacio concreto. Este novedoso bloque algorítmico permite a un dispositivo de RV localizar tu ubicación, identificar aspectos geométricos de la estancia (como la ubicación del suelo) y rastrear las posiciones del visor y los controladores respecto de un mapa 3D que Insight genera y actualiza constantemente. Los datos utilizados para este proceso provienen de tres tipos de sensores integrados en el hardware de Quest y Rift S:

- Los datos de aceleración lineal y velocidad rotacional de las IMU en el visor y los controladores se integran para rastrear la orientación y posición de cada uno con una latencia baja.

- Los datos de imagen de las cámaras del visor ayudan a generar un mapa 3D de la habitación, destacando elementos clave como las esquinas de los muebles o los patrones del suelo. Estos elementos clave se observan repetidamente, lo que permite a Insight compensar las desviaciones (un reto habitual con las IMU, donde incluso las discrepancias de medición más pequeñas se acumulan con el paso del tiempo, lo que afecta a la precisión del rastreo de posición).

- Las cámaras del casco detectan los LED infrarrojos de los controladores, lo que permite al sistema limitar la desviación de la posición de estos últimos mediante la integración de múltiples IMU.

Cuando te mueves, Oculus Insight detecta píxeles en imágenes con alto contraste, como las esquinas de una ventana. Estas zonas de imagen de alto contraste se rastrean y asocian con el paso del tiempo, de una imagen a otra. Al contar con una base suficientemente amplia de observaciones, Oculus Insight puede triangular la posición 3D de cada punto en su entorno. Esto sienta las bases del mapa de entorno 3D del sistema.

Las primeras grandes aplicaciones de la tecnología SLAM tuvieron lugar en la robótica, concretamente en las primeras generaciones de vehículos sin conductor, que se basaban en cantidades ingentes de recursos informáticos (varios ordenadores de a bordo) y utilizaban sensores caros (como IMU de navegación) y con un alto consumo energético (por ejemplo, sistemas Lidar 3D). Más recientemente, los ingenieros han introducido técnicas que permiten integrar el SLAM en hardware menos potente, incluso en teléfonos móviles para lograr efectos de RA en juegos y filtros de cámara. Pero aunque puede aceptarse cierto grado de desfase o imprecisión en el rastreo de posición en contextos de RA en teléfonos y dispositivos portátiles, la RV sin cables requiere un nivel sin precedentes de velocidad, exactitud y precisión para una aplicación SLAM de consumo. Esto se debe a que, en la RA en dispositivos portátiles, el efecto 3D ocupa una pequeña área del campo visual general del usuario, y el contenido puede sincronizarse temporalmente para reducir la latencia. En cambio, el contenido en la RV ocupa todo el campo visual del usuario, y el sistema ha de responder tan rápido como el usuario pueda moverse. Esto hace que los posibles errores de rastreo sean mucho más evidentes e incrementa considerablemente la dificultad de funcionamiento de Insight en Oculus Quest y Rift S.

El SLAM aborda estos retos reconociendo automáticamente características en el entorno, lo que permite a Oculus Insight incorporar la posición actual del jugador en un monitor de RV. Insight también utiliza una función de extrapolación con amortiguación dinámica que ayuda a predecir hacia dónde se moverán la cabeza y las manos del usuario en los próximos milisegundos. Esto brinda diversas ventajas, como reducir el efecto de "temblor" visual, que es la métrica clave con la que se comparan los sistemas de rastreo. Para permitir una experiencia de RV cómoda, el rastreo debe ser submilimétrico, lo que implica que el sistema es capaz de rastrear con una precisión más que milimétrica. Insight supera este objetivo en la mayoría de los entornos.

Otro factor importante que hay que evitar en la creación de experiencias inmersivas es la latencia; cualquier desfase entre los movimientos físicos y sus equivalentes en RV puede desorientar al usuario y afectar a la sensación de realismo. Mediante datos de IMU de baja latencia y un modelo cinemático que predice el próximo movimiento de un usuario, Insight es capaz de eliminar eficazmente el latencia aparente. En el siguiente apartado profundizaremos más sobre el proceso de fusión de sensores que incorpora los datos de SLAM, pero reducir tanto el temblor como la latencia es fundamental para que Insight pueda ofrecer un nuevo nivel de realismo en la RV.

Y la tecnología SLAM también ofrece ventajas más sutiles como, por ejemplo, contribuir a minimizar esa sensación de "mareo" o desorientación que puede notarse cuando los movimientos físicos no se reflejan correctamente en los movimientos correspondientes en la RV, como un movimiento de espada que va demasiado rápido o llega demasiado lejos. Este problema es diferente al de los movimientos desfasados que genera la latencia, e Insight se basa en su precisión de rastreo para evitar el mareo que, a veces, generan las diferencias entre los movimientos en el mundo real y los de la RV.

Mejorar la precisión mediante la captura de movimiento y la simulación de dispositivos

Desarrollar un sistema que aborde una gama tan amplia de posibles cuestiones en un producto lo suficientemente robusto para el mercado de consumo implicaba un conjunto de desafíos técnicos de igual envergadura. La mayoría de ellos guardaban relación con dos objetivos: la precisión y la eficiencia.

Algunos aspectos de precisión son fácilmente cuantificables, como el nivel de precisión submilimétrico que logramos para reducir el temblor. Pero otras experiencias, como el mareo, se basan -al menos, parcialmente- en el punto de vista subjetivo del usuario: la oscilación de una raqueta de tenis que podría parecer que se mueve demasiado rápido o que llega demasiado lejos, aunque las mediciones externas basadas en sensores no necesariamente lo registrarán como un error. Cuantificar y, en última instancia, salvar la brecha entre los movimientos físicos y los de la RV requiere un nuevo enfoque para medir esas discrepancias.

Nuestra solución fue un extenso análisis de datos de sensores que comparamos con datos procedentes de capturas de movimientos externos recopiladas por una selección de cámaras OptiTrack. Estas cámaras, similares a las que se utilizan en las producciones de efectos visuales de Hollywood, se colocaron en espacios de trabajo de Facebook y en las casas de los empleados. Los sistemas OptiTrack rastreaban los iluminadores colocados en los visores de RV y los controladores de los participantes, así como por todos los entornos de prueba. Esto nos permitió calcular la posición 3D exacta de los usuarios de Quest y Rift S y, a continuación, comparar estas mediciones con el lugar en el que el algoritmo de rastreo de posición de Oculus Insight pensaba que se encontraban. A continuación perfeccionamos ese algoritmo sobre la base de posibles discrepancias en la captura de movimientos y los datos de posición, mejorando así el sistema mediante pruebas en cientos de entornos con diferentes iluminaciones, decoraciones y tamaños de habitaciones, todo lo cual puede afectar a la precisión de Oculus Insight.

Además de utilizar estos entornos de prueba físicos, también desarrollamos sistemas automatizados que reproducían miles de horas de grabaciones de vídeo e identificaban los cambios en el desempeño del sistema al visualizar cualquier secuencia de vídeo concreta. Y dado que Quest utiliza un chipset móvil, desarrollamos un modelo que simula el rendimiento de dispositivos móviles al funcionar en un equipo con servidor general, como las máquinas de los centros de datos de Facebook. Esto nos permitió realizar reproducciones a gran escala con resultados que representativos del rendimiento real de Quest, mejorando los algoritmos de Insight en el marco de las limitaciones del casco de RV en el que tendría que funcionar.

Diseñar una VA ultraeficiente y pensada para dispositivos

Aunque la precisión era importante para el rastreo de posición de Insight, también lo era la necesidad de un nivel de eficiencia de VA sin precedentes. Oculus Quest procesa gráficos de alta calidad en tiempo real con resoluciones y frecuencias de fotogramas comparables, e incluso superiores, a las de los videojuegos de PC y consola, en un sistema de computación que consume dos órdenes de magnitud menos de potencia que un ordenador o una consola. En paralelo, también integra tecnología SLAM en tiempo real y un sistema de rastreo con controladores. Ejecutar todo esto a la vez con un orden de magnitud menos de potencia de computación, dos órdenes de magnitud menos de potencia total y un ancho de banda de memoria considerablemente inferior al de un PC moderno fue todo un reto de sistemas.

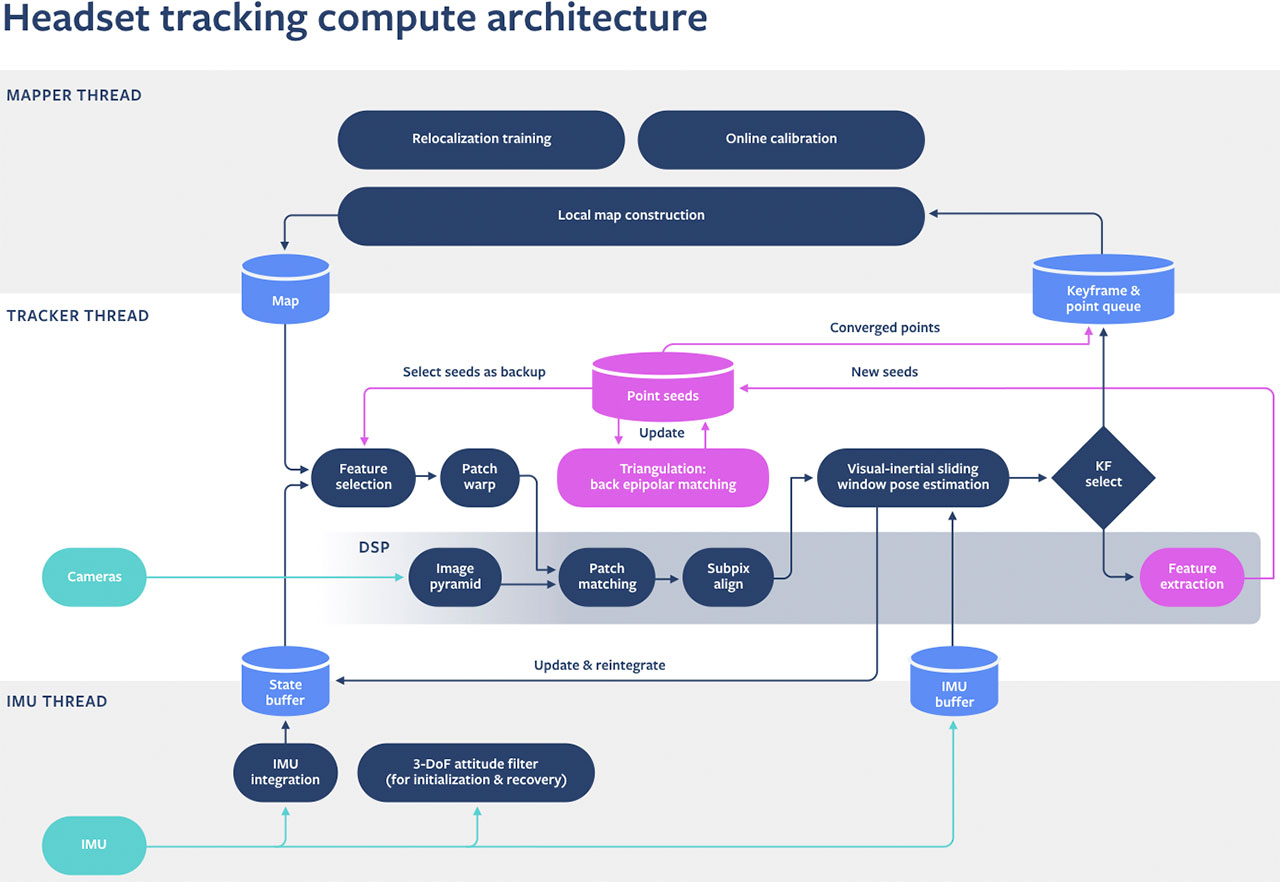

No se aplicó un único enfoque a la racionalización de este proyecto computacional, sino más bien una gama de ajustes multiproceso diseñados para su ejecución en dispositivos con muchas operaciones activas de manera asincrónica.

Por ejemplo, empleamos las optimizaciones de procesamiento de señal digital (DSP) específicas de Quest, como la actualización asincrónica de mapas, lo que permite al sistema perfeccionar y actualizar mapas basados en cambios en el entorno del usuario, pero en un segundo plano. Entretanto, los datos de IMU se ejecutan en su propio subproceso de prioridad superior, y el resultado se almacena en un buffer de memoria compartida para minimizar la latencia del sistema.

La coordinación de los distintos subprocesos en el proyecto asíncrono y determinista de Insight trajo consigo retos para el análisis de rendimiento offline, especialmente cuando el resultado de una determinada operación asincrónica está disponible un poco antes o después de lo normal, lo que puede generar un efecto mariposa que cambia drásticamente el estado general. Una actualización del mapa que se produzca un fotograma antes de lo normal podría modificar el momento de inicialización de nuevas funciones, lo que a su vez afecta a la exactitud de todo el mapa local.

Para controlar la sincronización de subprocesos, desarrollamos un modelo de predicción sobre datos de rendimiento a nivel de módulo en miles de ejecuciones en cientos de entornos reales, lo que permite predecir la latencia que una determinada operación generaría en el sistema multiproceso.

Otras optimizaciones buscaban específicamente mejorar la eficiencia de potencia, ya que además de los recursos de computación limitados de Quest (en comparación con los de un dispositivo conectado a un PC), los cascos de RV autónomos han de maximizar la duración de la batería. Por ejemplo, asignamos el código de rastreo y servicio del sistema operativo para su ejecución en los núcleos Silver de 1,9 GHz de bajo consumo de Quest, dejando los núcleos Gold de 2,45 GHz de mayor rendimiento del casco de RV y la unidad de procesamiento gráfico disponibles para ejecutar aplicaciones y juegos. Combinar este enfoque multinúcleo con la implantación multiproceso de Oculus Insight también nos permitió reducir aún más las latencias.

El futuro de la IA espacial

Oculus Insight sienta las bases para una innovación sin cables en la RA y la RV, que brinda a los usuarios de Quest una precisión sin cables y eficiente en cuanto a capacidad y computación para mantenerlos dentro de los límites del espacio de juego que han definido, al tiempo que se evitan los obstáculos del mundo real. Este trabajo podría tener notables repercusiones para los investigadores centrados en el SLAM, así como para cualquier sistema que pueda sacar partido del mapeo de habitaciones de alta precisión y escasos recursos, como los asistentes digitales y los robots físicos.

Este sistema de rastreo también se enmarca en nuestra visión a más largo plazo de incorporar la tecnología de IA espacial en todos los dispositivos conectados y plataformas que Facebook está desarrollando. Hasta el momento, nuestras aplicaciones de IA espacial incluyen Oculus Insight, lo que pone de manifiesto que este enfoque es viable en aplicaciones de consumo, y las reconstrucciones 3D fotorrealistas que Facebook Reality Labs creó para el conjunto de datos Replica, destinado a la investigación. Pero el futuro de esta tecnología reside en las gafas de RA de uso diario, que tienen conciencia espacial. Esto requerirá ejecutar la tecnología SLAM con todavía más limitaciones, incluida una mayor reducción de las latencias y disminución del consumo de energía hasta nada menos que un 2% de lo que se precisa para el SLAM en un casco de realidad virtual. Superar estos obstáculos requerirá de innovaciones en hardware, así como del desarrollo de la IA para optimizar aún más el proceso de sintetización de múltiples datos de sensores. El objetivo final de este trabajo es ofrecer experiencias de RA y RV que no solo sean más inmersivas, sino que también se integren en el mundo físico.

Usuario eliminado (9543)

Visores

#1 22 AGO 2019 20:51

Me voy a por las gafas de leer

AnonimoJose

Visores

#2 22 AGO 2019 21:30

Muchas gracias, superinteresante.

A los que indican que un visor es caro o barato basandose solo en lo que cuestan los componentes físicos que lo componen, les recomiendo que se lean este articulo. Crear un sistema de tracking como el que llevan las Quest/Rift requiere miles y miles de horas de pruebas en laboratorios situados en diferentes continentes con hardware carisimo, donde trabaja decenas/centenares de ingenieros altamente qualificados. Todo eso se traduce en cientos de millones de inversión, durante años.

Respecto al tracking Inside Out, ahora mismo solo Microsoft y Oculus han sido capaces de sacar una solición viable para dispositivos de consumo, y Oculus es la unica que lo ha conseguido en un disponistivo StandAlone para el mercado de masas.

Microsoft consiguió su inside Out para sus visores VR de forma indirecta, ya que fue a traves de su grandisma inversión en generar las Hololens, como obtuvo el tracking que luego utilizó en los visores de VR.

Por desgracia, parece que Microsoft no está muy interesada en VR, y su tracking ahora mismo está por detras de Oculus.

Habrá que ver que tal va el tracking Inside Out de HTC con las Cosmos, si consigue llegar al nivel del Inside Out de Oculus/Facebook (como hemos visto en el articulo no todo son camaras muchisimo se basa en AI/Software y otros sensores), y habrá que ver si Valve es capaz de sacar un Visor Inside Out, lo último que leí es que no estaban muy contentos con los resultados que ofrecía el Inside Out actual (no se si el que habían conseguido ellos o el de la competencia), porque está claro que el futuro es este Tracking.

cbas_theor

Visores

#3 22 AGO 2019 22:21

Otro nivel oculus.

oldsysop

#4 » Respuesta a cbas_theor #3 23 AGO 2019 0:42

Hypernova

#5 » Respuesta a oldsysop #4 23 AGO 2019 7:19

Por más que los hatees la que mejor lo está haciendo es Oculus, y lo sabes pero no lo quieres reconocer.

Cuando se van los fundadores de una empresa vendida es primero porque son millonarios con la venta y segundo porque ya no mandan y les jode.

Además Zuckerberg hace lo que Carmack diga por miedo a que se vaya.

AnonimoJose

Visores

#6 23 AGO 2019 11:04

Carmack ha re tuiteado los artículos indicando:

twitter.com/ID_AA_Carmack/status/1164580841453998080?s=19

Mucha gente pensó que el tracking inside out estaba "resuelto" hace más de 5 años, pero el camino desde la torre de Marfil hasta visores para consumidores ha sido largo y complicado.

oldsysop

#7 » Respuesta a Hypernova #5 23 AGO 2019 21:19

Eso explica el fracaso de la RV (lamentablemente).