Visores virtuales 2.0: Actualización vs. Evolución.

14 SEP 2016 9:05

¿Por qué siempre queremos más?

Cualquiera que haya probado la realidad virtual por primera vez–y se haya dejado llevar por el fatalismo de las expectativas sobre dimensionadas- dirá que esta versión 1.0 adolece de dos grandes males: claridad y campo de visión. Sin entrar a valorar lo que se podía haber diseñado con la ciencia de hace escasamente un año, hay varios avances que vienen sonando con fuerza en las ferias de tecnología internacionales y muchas de ellas encajarían perfectamente en el ecosistema 2.0 de la Realidad Virtual.

Pues verá -dijo Oliver Twist-, me gustaría tener unos visores mejores. ¿Le importaría ponerme un poco de HDR, por favor?

Pantallas adaptadas a la recomendación Rec.2020

Se dice de ella que es la gran revolución que faltaba y para muchas marcas, la auténtica esperanza blanca después del fiasco del 3D. Desde los años 90, con el nacimiento de la HD, los paneles han sufrido mil mejoras, se han vuelto planos, inteligentes y su resolución se ha disparado. Pero nuestros ojos han seguido contemplando sus colores limitados por un estándar muy restrictivo y que nada tiene que ver con la potencia de las cámaras actuales, capaces de capturar más gamas de colores de lo que luego nuestras pantallas permiten representar. Para hacernos una idea del cuello de botella actual, veamos dónde estamos y luego vayamos un instante hasta dónde nos quieren llevar de aquí a muy poco.

Más color para todo... aunque no necesariamente quede más natural. Cuidado con pasarse o terminarás viviendo en el universo imaginado por Ágatha Ruiz de la Prada.

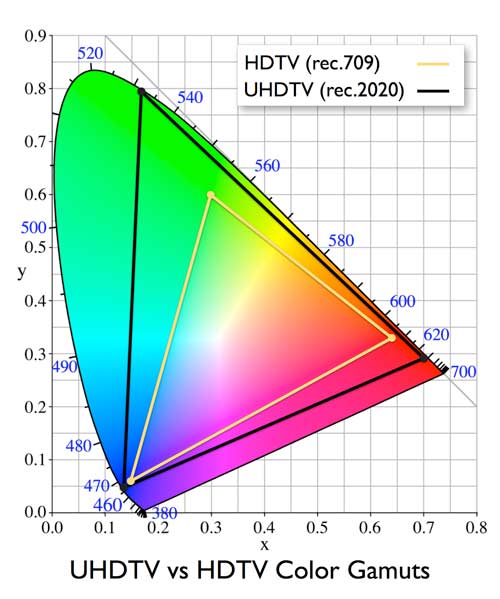

La recomendación a la cual se encomiendan los televisores y monitores actuales FullHD se denomina Rec.709. Este documento, además de establecer ciertos mínimos y máximos tanto de resolución como de tasas de refresco y coeficientes de luma, habla también del espacio de color. Y aquí viene lo bueno. Hace muchísimo tiempo, unos ingenieros se las arreglaron para calcular matemáticamente la cantidad de colores distintos que podía ver un ser humano. Lo llamaron CIE 1931 (por su fecha) y proporciona una manera de cuantificar cuántos colores puede mostrar una pantalla cualquiera (Gamut). La recomendación actual Rec.709 obliga a los paneles a mostrar un 31,1% del espectro CIE 1931, mientras que la nueva recomendación Rec. 2020 lo sube hasta el 71% (y a esto lo llaman Wide Color Gamut). De forma un poco más técnica, pasaremos de cuantizar en 8Bit hasta los 10 o 12bits. ¿Qué ganamos los usuarios? De momento, un billón de colores diferentes frente a los “solo” 16 millones actuales.

Pero eso no es todo. La Rec 2020 también guarda otra revolución bajo el brazo. Hablamos del famoso HDR. Las siglas más usadas después de WTF se aplican a High Dynamic Range, o Alto Rango Dinámico. Y no hay feria, blog técnico o charla de ascensor en las que últimamente no aparezca este concepto. Por si acaso alguno anda despistado, este HDR no es ese HDR que tienen las cámaras de fotos de tu móvil. Uno se aplica a una técnica fotográfica y el otro a una tecnología de video. ¿En qué consiste el HDR de las nuevas pantallas que arrasarán los centros comerciales estas navidades?

Con HDR todo parece más natural, incluidas las marcas que el visor 2.0 dejará en tu frente cuando te las quites

HDR afecta al contraste. Nos dice, entre otras cosas, que la distancia entre el punto negro más profundo de la imagen y el punto blanco más luminoso, será mayor que con el estándar 709. Por añadidura,, los escalones de grises que tendremos a nuestra disposición, situados entre medias de cada extremo, también se verán ampliados de manera substancial. Hablando de los extremos, la UHD Alliance obliga a los fabricantes de pantallas a decidir entre dos posibles certificaciones: La 1ª establece un negro con una oscuridad de menos de 0,05 nits y un blanco de más de 1.000 nits, y la 2ª un negro de menos de 0,0005 y un blanco de 540 nits. Lo normal será que una pantalla LED opte por la primera certificación (menos negros pero blancos más brillantes), mientras que una OLED se decante por la segunda (negros negrísimos pero blancos algo más pálidos que una LED). Por resumir, un panel compatible con HDR podrá leer toda esa información de contraste codificada en el video HDR (los distintos escalones de contraste) y la mostrará en pantalla de manera fiel, mientras que uno no compatible simplemente desechará toda esa información extra y encajará ese contraste más complejo dentro de los límites que le impuso la norma 709.

La primera consecuencia obvia será que las imágenes oscuras tendrán muchísimo más detalle que antes y las luminosas muchísimo más brillo sin llegar a la saturación. Eso sí, a costa de añadir una sobrecarga adicional del 20% en su ancho de banda (Ya hablaremos de los estándares HDMI, DisplayPort, de los flujos de datos que permiten y de por qué la necesidad de actualizar sus estándares de tanto en tanto). En lo que concierne a la RV 2.0, cuando las pantallas de nuestros nuevos visores sean compatibles con HDR, los mundos virtuales se volverán, sin exigir un aumento en la potencia de procesado, más vívidos y más reales. Para bien o para mal esto incluirá también que veamos las bandas rojas de algunas Oculus más nítidas y en perfecto HDR ;).

Con el HDR vamos a poder distinguir por fin entre el verde pistacho, el verde aceituna

y el verde espuma de mar

Se dice entre los profesionales de la imagen que la calidad de una señal a 1080p en HDR bien codificada es mejor que una señal 4K estándar. Netflix está adaptando su catálogo a HDR, tanto en HD como en UHD. Los juegos y las consolas también se preparan para la revolución HDR. ¿Pero es HDR un estándar global que facilitará la vida a los usuarios? No. Como en toda tecnología emergente, existen distintas propuestas patrocinadas por fabricantes diferentes. Samsung y Sony tienen su propio HDR, al que llaman HDR10. LG y Vizio tienen Dolby Vision (creada por los laboratorios Dolby). HDR10 es el sistema elegido por los nuevos Blu-Ray UHD, por la nueva PS4 Pro y la XBOX One S. ¿Por qué Dolby Vision sigue la lucha? Porque muchos de los contenidos HDR de la Warner, MGM y la universal solo se verán en pantallas compatibles con Dolby Vision. AMD y NVIDIA, por su parte, ya dan soporte para HDR10 en gaming desde hace dos generaciones (Maxwell, Pascal y Polaris) aunque solo en ciertas resoluciones. Suponemos que el lío concluirá con los dos estándares, uno de pago (Dolby) y otro libre (HDR10), soportados por todos los fabricantes, así también como lo terminarán haciendo nuestros visores.

El plan de AMD para el soporte HDR por resoluciones.

Mi visor me acaba de hacer un test de Voight-Kampff

En el universo soñado por Palmer Luckey, Gabe Newell, Carmack y Abrash, las tarjetas gráficas renderizan en tiempo real resoluciones de 35K a 120fps sin despeinarse. En el universo de un usuario común, mover 2K a 90fps hace que su GPU funcione de calefacción central para todo el bloque de vecinos un diciembre cualquiera. En épocas de escasez el ingenio es el mayor de los activos. De ahí que muchos se preguntarán, ¿y si en vez de renderizar por completo toda la imagen (los 2K, por ejemplo), escaneamos en tiempo real los movimientos de la retina y conseguimos enviar a la fóvea (el lugar donde convergen los rayos de luz dentro del ojo) solo el renderizado perfecto de una pequeña porción central de la imagen y el resto lo presentamos a baja resolución? Según todos los estudios, y este práctico ejemplo, nuestro órgano de visión es incapaz de distinguir con detalle lo que ocurre en la llamada visión periférica. ¿Para qué malgastar la poca potencia que tenemos renderizando algo que nuestros ojos nunca serán capaz de disfrutar? Esto que suena a BladeRunner y al sueño mojado de Facebook –además de saber con quién ligas, a dónde vas, también voy a saber hacia dónde estás mirando- sería la solución a la capacidad tan limitada de proceso que tienen las gráficas actuales (incluyendo tu flamante 1080GTX). Por un lado rebajaría los mínimos en cuanto a potencia gráfica y por otro, el excedente podría ser usado para extender el tamaño de las pantallas (y su campo de visión FOV) sin penalizar la calidad del render final que verían nuestros ojos.

Existen modelos y técnicas (SMI, Nvidia y AMD, por ejemplo) que posibilitan el renderizado selectivo según el movimiento de nuestros ojos y no parece descabellado decir que de alguna manera u otra, en la versión 2, 3 o 4, esta tecnología terminará dentro de uno de nuestros visores.

Matrixx05

#11 14 SEP 2016 18:02

Yo creo que no debería ir tan rápido esta generación .

Después de testear y probar , solo os digo que ni con una TitanX ni con una 1080 hoy en día se puede jugar a los juegos punteros a 4K a 60 FPS estables ( evidentemente con calidad muy alta ) y eso que para ir bién deberiamos tener unos 90 FPS estables para una RV de calidad .

Pero el problema es que , en este mundillo , y eso es mi opinión , falta más grueso de usuarios y más juegos o experiencias de calidad . Creo que por el momento deberíamos ir paso a paso , dejemos tiempo a los desarrolladores para que nos hagan soñar con el hardware actual que ya es mucho .

No matemos la RV antes de empezar .

Usuario eliminado (3550)

#12 14 SEP 2016 20:53

Como dicen por arriba lo que necesitamos es un standard... Que los Chinos y otras compañías se metan a fabricar y compitan entre ellas y mejoren sus productos.

snake

#13 14 SEP 2016 20:54

Impresionante articulo!

Yo opino que ahora mismo lo mas importante és conseguir una imagen nitida i limpia (sin efectos Glare ni otros) para evitar el cansancio visual i los posibles mareos consecuentes.

Aunque yo viera pixeles de por medio lo que más me desespera es que no pueda enfocar limpiamente los letreros i los objetos, como si necesitara gafas (no he tenido ocasión de provar todavia un producto final, pero por lo que explicais i las imagenes que he visto, sin duda es lo que más me preocupa.

Cdaked

Visores

#14 14 SEP 2016 21:05

Artículo de primera.

¿Qué es lo que mejorará seguro? 10 o 20º de FOV. Ligero aumento de la resolución. Y Foveated rendering como gran estrella.

Mejoras en las conexiones (por cable, hasta que no mejore alguna tecnología inalámbrica)

No mucho más en el plazo de un año, año y medio.

Jam-gino

Visores

#15 15 SEP 2016 12:58

Claramente subiria la resolucion, y tan importante como eso el aumento de Fov entorno a los 150 grados. Con eso subiriamos mucho la experiencia.

talekliaran

#16 15 SEP 2016 16:05

Habiendo probado solo el dk1 y dk2 y habiéndome hecho a la idea de las mejoras que se comentan del cv1...

por gusto mio, que aumentasen mas el fov prioritariamente. No vengo de jugar en ULTRA en pc y me acostumbro rápidamente a lo que me ofrezcan en resolución.130°seria una cosa mas llevadera y agradecida (antes incluso que la resolución y el inalámbrico).

En cuanto a lo que harán: mejorarán la comodidad y peso, tamaño, precio (bajara a la mitad este en cuanto salga el otro) pero sobretodo aumentará la calidad y cantidad del software.

Zky.

#18 15 SEP 2016 16:40

Que quiten el glare.

Lorient

#19 15 SEP 2016 21:34

Creo que la próxima generación será dentro de dos años, y los cambios más importantes por prioridad son:

1.- Eliminar los mareos es la prioridad número uno. Hay varios estudios de cómo conseguirlo, aunque no sabemos si funciona al 100%. Si una de las compañías lo consigue y el resto no, la primera se llevará todo el mercado. Ahora somos 4 gatos que aceptamos cualquier cosa, pero dentro de 2 años la RV será extensible al resto de población, y nadie comprará un HMD que provoque mareos. Es posible que no lo consigan al 100% y en la tercera generación lo eliminen en su totalidad.

2.- Aumento de resolución. Sin duda mucho más importante que el FOV. Con menos FOV se puede jugar a todo, pero con la resolución actual hay juegos que están muy limitados. El aumento de resolución será importante y dependerá de si son capaces de hacer seguimiento ocular para poner 4k o quedarse en algo menos. Pero como aumentarán también el FOV con pantallas más grandes, supondrá seguir necesitando aún más resolución para generaciones posteriores. Yo creo que pondrán 4k por un motivo evidente, cuando sacaron el Crescent Bay, Oculus ya dijo que estaban haciendo pruebas con pantallas 4k, y dentro de 2 años habrá tarjetas gráficas que las aguante, ya sea por su potencia o porque se utilice algún truco como el seguimiento ocular o el nuevo sistema de Nvidia para generar las imágenes con menos coste de GPU.

3.- Eliminación de los cables. Ya lo dijo Palmer, los cables limitan muchísimo, y estaban trabajando en ello. Es algo prioritario para la segunda generación, ya que ahora estamos inmersos en un mundo virtual y el puñetero cable nos recuerda que existe el mundo real y tenemos que apartar el cable para no tropezarnos.

4.- Aumento del FOV, esta claro que lo aumentarán, pero seguiremos viendo los límites de la pantalla. El FOV se seguirá aumentando en futuras generaciones a medida que también aumentan la resolución. Algunos dirán que para ellos el FOV es la prioridad número uno, bueno, cada cual tiene sus prioridades. Pero para mi, el FOV actual es poco pero no te limita en absoluto jugar a nada, en cambio lo comentado anteriormente si limita.

5.- Es imposible jugar más de 5 minutos seguidos en pleno verano. Con esas esponjas en la cara y más de 30 grados de temperatura empiezas a sudar y te tienes que quitar el HMD. Esto tienen que solucionarlo de alguna manera, los HMD tienen que ser cómodos en todos los sentidos.

6.- El efecto glare lo dejo de los últimos porque doy por hecho que desaparecerá después de las críticas brutales a ambas compañías, no me preocuparía por esto.

7.- Eliminación de las cámaras. Esto no creo que lo quiten en la segunda generación, lo harán en la tercera o cuarta generación, ya que podremos aguantar unos años más con unas cámaras que no te entorpecen la experiencia.

jjro35

#20 » Respuesta a Lorient #19 17 SEP 2016 23:19

Eso de que es imposible jugar más de 5 minutos seguidos en pleno verano... serás tú. Coño, un ventilador al lado y listo. Yo me lo he pasado pipa estas vacaciones.